Vue lecture

Facture surprise pour les étudiants aux cycles supérieurs de l’UQAM

Where Russia takes kidnapped Ukrainian children for “re-education” – 210 facilities identified

A study by the Humanitarian Research Lab (HRL) at Yale University’s School of Public Health has identified 210 facilities in Russia and occupied Ukrainian territories where children abducted from Ukraine are held and “re-educated.” The report also found evidence that some children are being militarized.

“Russia has been engaged in the deportation, re-education, militarization, and coerced fostering and adoption of children from Ukraine since at least 2014 in the temporarily occupied territories of Crimea, Luhansk, and Donetsk. Following the full-scale invasion of Ukraine by Russia in February 2022, these efforts significantly expanded in scale and scope. Cohorts of children were rapidly included in the Russian Federation’s pre-existing program of Russification from newly occupied regions such as Zaporizhzhia, Kherson and cities such as Kharkiv and Mariupol.” – the report reads.

210 “re-education” facilities for Ukrainian children

The majority of the facilities identified in the report are located in European Russia and occupied Crimea.

Children are being held in camps and sanatoriums (most frequently), as well as cadet schools, a military base, medical facilities, a religious site, secondary schools and universities, a hotel, and family support centers and orphanages.

Researchers found that re-education activities occurred at 130 sites (62%), involving cultural, patriotic, or military programming aligned with pro-Russia narratives.

Militarization programs were observed at 39 sites (19%), and 49 sites (23%) have been expanded or newly constructed, including two new cadet schools, likely to accommodate more children.

More than half of the facilities (106 of 210) are managed by the Russian federal or local government, including 55% of re-education sites and 58% of militarization sites.

Children in these facilities fall into four main groups:

- children taken to summer camps for what was intended to be temporary “re-education” by pro-Russian patriotic organizations;

- children taken from Ukrainian orphanages and other institutions for children, and/or children with physical disabilities;

- children forcibly separated from parents in frontline areas after the 2022 invasion; and

- children taken directly from their parents in Russian-operated filtration camps in and around Mariupol in 2022 when the city was first occupied.

The report urges international organizations and governments to support the return and reintegration of Ukrainian children, hold perpetrators accountable, and strengthen protections to prevent such abuses in the future.

“The impact of the alleged crimes perpetuated by the Russian government are likely to leave generational scars,” the report concludes.

Russia’s history of abducting Ukrainian children

The systematic abduction of Ukrainian children has accelerated since Russia’s 2022 invasion, building on practices begun in 2014 in occupied Crimea, Donetsk, and Luhansk.

Over 3,000 children from occupied Kherson Oblast were taken to remote Russian regions during summer 2024 alone. Separate documentation identified 40,000 children relocated to various Russian locations including Moscow, Saint Petersburg, and facilities as far as 8,000 kilometers from Ukraine.

The International Criminal Court issued arrest warrants in March 2023 for Russian President Vladimir Putin and Russian Children’s Rights Commissioner Maria Lvova-Belova on charges of illegal child deportation.

Read also

Former C.D.C. Director to Tell Lawmakers She Was ‘Fired for Holding the Line’

© Tierney L. Cross/The New York Times

210 Russian facilities identified in systematic “re-education” of Ukrainian children, Yale study reveals

Researchers at Yale University have identified at least 210 facilities across Russia and occupied territories where Russian authorities illegally transport Ukrainian children for “re-education,” according to a new report from the Yale School of Public Health’s Humanitarian Research Lab (Yale HRL).

The study reveals the scope of what researchers describe as a systematic program operating since Russia’s full-scale invasion began in 2022. However, the actual number of facilities is likely higher, as Yale HRL continues investigating additional locations, according to the report.

The 210 identified facilities include military cadet schools, bases, medical institutions, religious sites, secondary schools, universities, hotels, family support centers, and orphanages. Most frequently, the locations are camps and sanatoriums, researchers found.

At least 130 of these facilities implemented “re-education” measures that include pro-Russian cultural, patriotic, or military programs, the study documents. Ukrainian children are forced to sing the Russian anthem, attend pro-Russian events, and participate in history and geopolitics lectures conducted entirely in Russian.

The report separately identifies 39 facilities where deported children undergo militarized programs that include combat training. While some organizations claim their programs target children aged 14 and older, Yale researchers note that participants appear to range from 8 to 17 years old.

Children in these military programs are forced to develop firearms and naval training skills, participate in shooting competitions and grenade throwing, and receive instruction in tactical medicine and drone operation, according to the findings.

Researchers documented one instance where children from Donetsk region underwent “airborne training” at a military base, transported there by aircraft belonging to the Russian presidential property management office.

The Russian government directly operates more than half of the documented locations, Yale University researchers emphasize. At least 106 facilities are managed by Russian federal or local government authorities.

The study builds on previous Yale HRL research that identified more than 8,400 children from Ukraine systematically relocated to at least 57 facilities, including locations in Belarus and Russia-occupied territories. Separate research has documented 314 individual Ukrainian children transferred to Russia for coerced adoption and fostering, actions the International Criminal Court has characterized as war crimes.

The investigation spans 20 months of research and represents what experts describe as the largest missing persons case since World War II.

Soutien à l’enseignement et activités limités cette année dans plusieurs écoles

Des parents mis en demeure par leur CSS pour ne pas avoir approuvé le budget de leur école

Les élèves de l’école incendiée Val-des-Monts seront de retour en classe jeudi

Incertitudes sur la remise en service des autobus scolaires de Lion Électrique

Un autobus de transport scolaire de l’entreprise de Saint-Jérôme a pris feu la semaine dernière dans le quartier Côte-des-Neiges, à Montréal.

- C’était le troisième incendie depuis l’automne dernier impliquant un autobus de Lion Électrique.

Le gouvernement Legault avait ordonné jeudi soir la mise à l’arrêt de 1200 autobus scolaires afin que les transporteurs puissent inspecter leurs véhicules.

- Des centres de services scolaires avaient dû annuler vendredi leurs circuits d’autobus.

Hier soir, plusieurs centres ont indiqué que l’interruption du transport scolaire allait se poursuivre.

[L'article Incertitudes sur la remise en service des autobus scolaires de Lion Électrique a d'abord été publié dans InfoBref.]

L’arrêt de 1200 autobus de Lion Électrique a perturbé le transport scolaire

Les médecins spécialistes adoptent de nouveaux moyens de pression

La Fédération des médecins spécialistes du Québec a annoncé que ses membres allaient, à compter de lundi et jusqu’à la conclusion d’une entente de principe avec le gouvernement, cesser de:

- superviser les étudiants en médecine;

- participer à des réunions avec des représentants du ministère de la santé.

La Fédération a indiqué qu’elle pourrait également par la suite cesser de superviser les médecins résidents.

Le gouvernement Legault venait de soumettre aux spécialistes une nouvelle offre, dans laquelle une partie de leur rémunération restait liée à l’atteinte d’objectifs – ce à quoi les spécialistes s’opposent.

[L'article Les médecins spécialistes adoptent de nouveaux moyens de pression a d'abord été publié dans InfoBref.]

Plus d’immigrants francophones pourront étudier hors Québec l’an prochain, grâce à un projet élargi

Le personnel de soutien des collèges en Ontario déclenche une grève générale

LeBel et Biron accueillies avec espoir à l’Éducation et à l’Enseignement supérieur

Des parents endettés à l’endroit du réseau scolaire public

Le taux de diplômés a atteint un niveau record

Selon un rapport de l’Organisation pour la coopération et le développement économiques (OCDE), 48% des jeunes adultes des pays membres étaient en 2023 diplômés de l’enseignement supérieur.

- En 2000, la proportion était de seulement 27%.

Fortes inégalités

Près de trois quarts des jeunes issus d’une famille dont au moins l’un des parents avait un diplôme sont aujourd’hui diplômés.

C’est le cas de seulement un quart des jeunes issus d’une famille faiblement instruite.

L’OCDE regroupe 38 pays riches, dont Canada, États-Unis, Australie, Japon, et la majorité des pays de l’Union européenne.

[L'article Le taux de diplômés a atteint un niveau record a d'abord été publié dans InfoBref.]

Le gouvernement met à l’essai un nouveau programme de français

Le ministre de l’éducation Bernard Drainville a dévoilé une nouvelle version du programme de français destiné aux élèves du primaire et du secondaire.

Principales mesures:

- plus de place à l’oral – discussions, débats et mises en situation;

- lecture et écriture tous les jours – dès la première année du primaire;

- découverte chaque année d’au moins 5 expériences culturelles québécoises et 5 livres québécois.

Le programme sera:

- testé cette année dans une cinquantaine de classes; puis

- obligatoire dans toutes les écoles à la rentrée 2026.

Les syndicats de l’enseignement demandent au gouvernement de plutôt reporter son implantation obligatoire à 2027.

[L'article Le gouvernement met à l’essai un nouveau programme de français a d'abord été publié dans InfoBref.]

Institut maritime : plus d’étudiants, moins d’internationaux

L’Institut maritime du Québec (IMQ) amorce l’année scolaire avec 379 étudiants, une vingtaine de plus qu’à la rentrée 2024. Le contingent d’internationaux recule toutefois légèrement en raison de délais liés aux permis d’études.

En tout, 131 étudiants nouvellement inscrits provenant de toutes les régions du Québec et de l’international ont amorcé leur formation dans l’un des quatre programmes techniques offerts par l’établissement.

Cet automne, 45 étudiants des programmes Navigation et Techniques de génie mécanique de marine poursuivront leur apprentissage grâce aux stages en mer en naviguant sur les eaux canadiennes et internationales.

De plus, près de 150 personnes se tourneront vers le Centre de formation en plongée professionnelle pour développer de nouvelles compétences.

« Chaque rentrée est un moment privilégié où l’on sent l’énergie et l’enthousiasme de la communauté étudiante prête à embarquer dans une aventure unique. À l’IMQ, nous avons à coeur d’accompagner chaque personne dès le départ afin qu’elle se sente rapidement à l’aise et bien entourée. », souligne Mélanie Leblanc, directrice de l’IMQ.

Abordage Océan

L’IMQ a amorcé la nouvelle année scolaire de manière mémorable avec l’événement Abordage Océan, qui s’est tenu le 26 août dernier.

Cette journée d’accueil, véritable miroir de la culture et de la vie à l’IMQ, permet aux étudiants de tisser des liens entre eux ainsi qu’avec le personnel de l’école, dans une ambiance conviviale et dynamique.

Plus de 200 étudiants et membres du personnel se sont rassemblés au Domaine Valga pour une journée d’activités et de dépassement.

Cette activité est rendue possible grâce au soutien de la Fondation de l’Institut maritime et de Groupe Océan, partenaire de l’événement.

Échange international d’enseignants

L’année scolaire 2025-2026 est également marquée par un échange international d’enseignants avec l’École nationale supérieure maritime (ENSM) de Saint-Malo, en France.

Dans le cadre de cette collaboration, Alexandre Ouellet, enseignant à l’IMQ en Techniques de génie mécanique de marine, s’est envolé pour la France tandis que Jérôme Gaboriau, enseignant en mécanique navale, à l’ENSM, se joint à l’équipe enseignante de l’IMQ pour toute l’année.

« C’est une belle occasion de pouvoir enseigner à l’Institut maritime du Québec et de contribuer à la formation de la relève maritime. Cet échange permet de croiser les expertises, d’enrichir nos pratiques pédagogiques et d’accompagnement scolaire. Ce partenariat permet de renforcer les liens entre nos deux institutions », souligne monsieur Gaboriau.

Le gouvernement Legault va déposer cet automne un projet de loi pour renforcer la laïcité

Selon plusieurs médias, le gouvernement compte notamment étendre l’interdiction du port de signes religieux aux garderies et interdire les prières dans les lieux publics.

François Legault avait déjà indiqué qu’il envisageait d’interdire les prières hors des endroits religieux, comme les églises et les mosquées.

- Il n’excluait alors pas de recourir à la clause dérogatoire pour protéger un futur projet de loi en ce sens contre d’éventuels recours devant les tribunaux

Le projet irait plus loin que le comité sur la laïcité mandaté par le gouvernement.

- Le comité recommandait aux municipalités d’encadrer les prières de rue.

[L'article Le gouvernement Legault va déposer cet automne un projet de loi pour renforcer la laïcité a d'abord été publié dans InfoBref.]

Club des petits déjeuners : demandes en hausse dans l’Est

Le Club des petits déjeuners s’apprête à entamer une nouvelle année scolaire avec des demandes qui sont toujours en hausse au Bas-Saint-Laurent et en Gaspésie.

Au Bas-Saint-Laurent, ce sont 22 écoles qui adhèrent au programme des petits déjeuners contre 26 en Gaspésie et aux Îles-de-la-Madeleine.

On parle de 3900 élèves au total qui bénéficient de ces repas matinaux. Dans l’ensemble du Québec, c’est une augmentation globale de 20 % du nombre d’élèves qui participent au programme.

La conseillère principale pour le Club dans le volet nutrition, Catherine D’Amours, observe continuellement des besoins grandissants.

« Il y a quelques années, c’était la pandémie. Ensuite, ce fut l’inflation. Puis la flambée des coûts en raison des tarifs. On voit que les familles et les organismes sont sous pression. Dans ce contexte, on peut comprendre que d’assurer aux enfants d’avoir un repas tous les matins a beaucoup de valeur. »

Avec un petit bedon rempli, les enfants sont davantage en mesure de se concentrer sur les matières scolaires, et non pas sur la faim.

« Dans une journée, il y a beaucoup d’activités et de cours. C’est donc important de bien commencer la journée. De ne pas avoir faim, ça améliore les comportements et l’humeur », ajoute Catherine D’Amours.

Comment ça fonctionne ?

Le Club des petits déjeuners fonctionne sur un modèle adapté aux écoles. Un établissement peut vouloir obtenir de l’argent pour faire ses propres emplettes ou mandater un organisme pour gérer le tout. Chose certaine, le petit déjeuner est offert tous les jours de l’année scolaire.

L’idée est de rejoindre le plus d’enfants possible, mais comme les ressources sont limitées, le Club des petits déjeuners concentre ses efforts dans les régions où l’indice de dévitalisation est élevé.

Rappelons que l’organisation est née en 1994 à l’initiative de Daniel Germain, un homme ayant grandi dans un milieu modeste. Il a rapidement constaté que la pauvreté était présente partout au pays, de là l’idée de lancer un programme pour que les enfants puissent se nourrir tous les matins.

Un comité recommande d’interdire les signes religieux dans les garderies

Le comité mandaté au printemps par le gouvernement Legault pour renforcer la laïcité au Québec a publié son rapport. Il comprend 50 recommandations.

Quatre recommandations saillantes:

- étendre l’interdiction des signes religieux au personnel des CPE et des garderies subventionnées;

- mettre fin au financement des écoles privées religieuses;

- interdire la représentation et le port de signes religieux sur les affiches et dans les publicités du gouvernement;

- cesser d’écrire aux parents d’élèves pour les informer à l’avance qu’un contenu lié à la sexualité va être enseigné à leurs enfants.

[L'article Un comité recommande d’interdire les signes religieux dans les garderies a d'abord été publié dans InfoBref.]

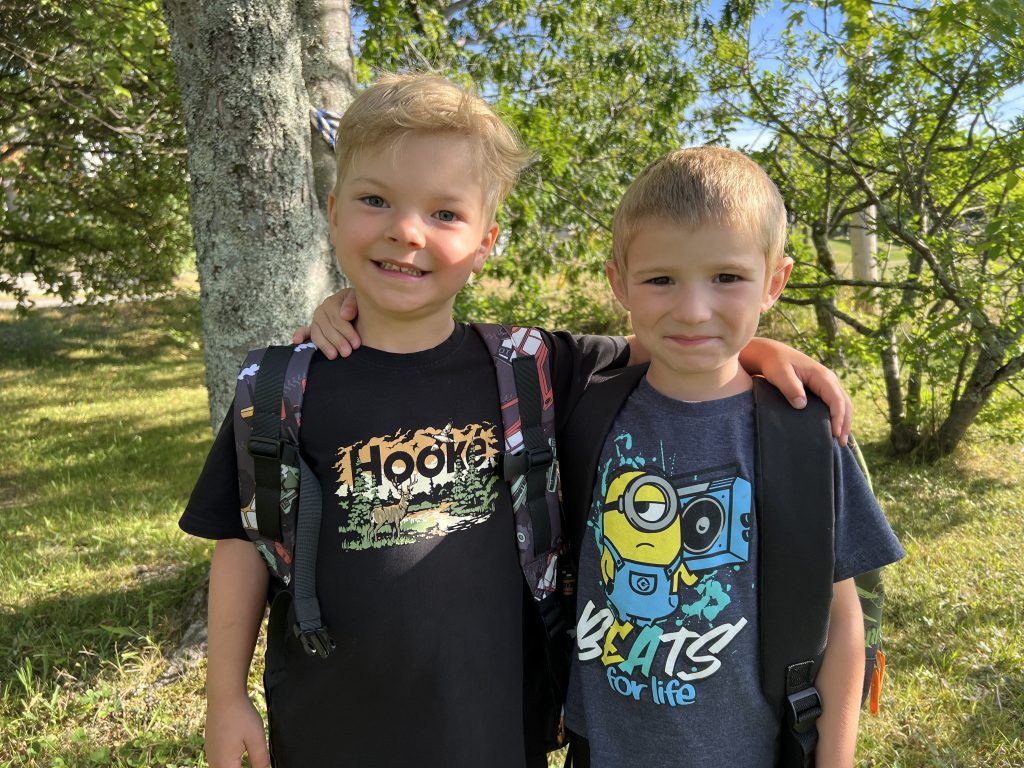

Rentrée scolaire : nouveau départ pour plusieurs tout-petits

C’est la rentrée scolaire pour des milliers d’élèves cette semaine. Noah Cimon, Tomàs Côté et Ophélie Verreault-Lechasseur, de Rimouski, entament une nouvelle étape puisqu’ils ont récemment quitté leur garderie pour se diriger vers la maternelle.

Les trois enfants de cinq ans sont impatients de rencontrer de nouveaux amis et surtout de s’amuser dans leur cour d’école.

« J’ai hâte de jouer avec la cuisinette que j’ai vue quand j’ai visité l’école. J’ai aussi hâte de voir mon casier et mon bureau dans ma classe », exprime Noah Cimon qui commence la maternelle cinq ans à l’école de l’Estran.

« Je sais que Noah est triste de quitter la garderie, mais qu’en même temps il a hâte de commencer l’école pour revoir des amis qu’il a connus au programme passe-partout et au hockey. J’enseigne au préscolaire donc je sais à quoi m’attendre. Nous sommes prêts », ajoute sa mère, Mireille Levasseur.

Double rentrée

Tomàs Côté fréquentera aussi l’école de l’Estran pendant la prochaine année. Pour lui et sa mère, Véronique Michaud, c’est une double rentrée puisque cette dernière a décidé de changer de carrière et de commencer des études en éducation spécialisée au Cégep de Rimouski.

« Je ne suis pas encore prête à ça et j’essaie de m’habituer. J’ai confiance, mais c’est une nouvelle étape et je suis nerveuse. Mon fils est prêt. C’est aussi un nouveau chapitre de vie qui commence pour moi. »

« J’ai hâte d’apprendre les lettres et de rencontrer ma professeure. J’ai vu qu’il y avait une nouvelle grande glissade bleue à mon école. Je vais glisser dedans vraiment très vite », s’exclame Tomàs.

La mère d’Ophélie, Jessica Verreault, a aussi confiance que cette rentrée se passe bien. Sa fille rejoindra sa sœur à l’école du Boisé-des-Prés.

« Nous sommes un peu stressés, mais nous avons hâte en même temps. Ophélie est impatiente de suivre Clara, ma plus vieille, parce que ça avait été un deuil pour elle quand sa sœur est partie de la garderie. Ce sera une belle étape et l’équipe-école nous accompagne bien. »

Bon accompagnement

Les mamans des trois enfants, tous au centre de la petite enfance la Trâlée des Prés, se sont senties bien accompagnées pour la transition entre l’école et la garderie.

« Le CPE nous a offert des documents pour nous donner des pistes et nous aider à ce qu’ils s’adaptent bien à cette rentrée scolaire. En étant en CPE, ils vivaient déjà avec plusieurs routines et plusieurs amis. C’est déjà une bonne préparation », conclut Mireille Levasseur.

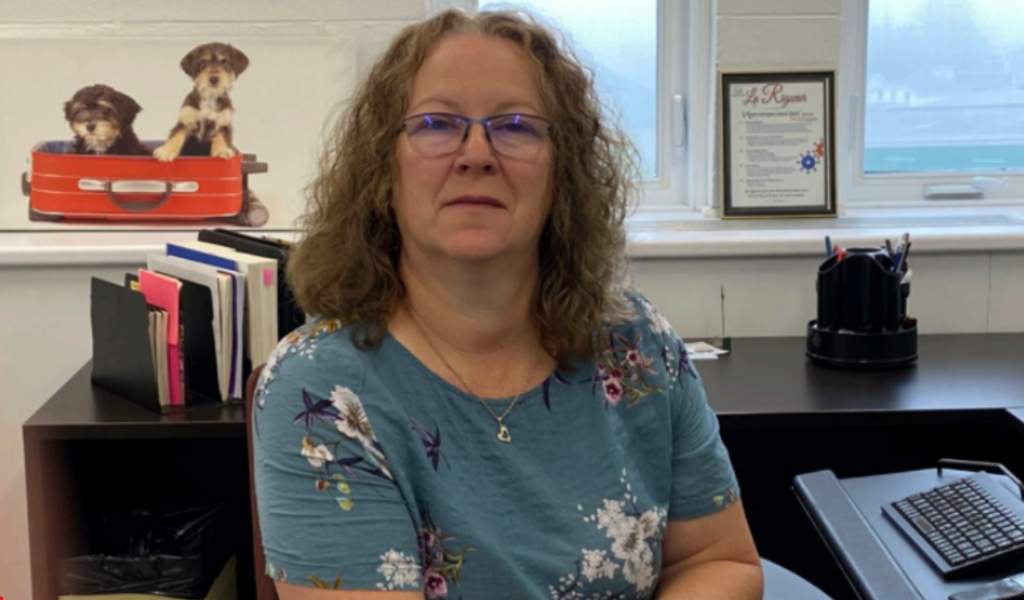

Cellulaires à l’école : le personnel sensibilisé

L’interdiction des cellulaires et des appareils mobiles, instaurée par le ministre de l’Éducation, Bernard Drainville, qui sera en vigueur dès la rentrée 2025 dans les écoles de la province, ne s’adresse pas aux membres du personnel de ces mêmes écoles.

Si le Journal de Québec rapporte que certains établissements, notamment à Montréal, ont fait parvenir des consignes strictes au personnel enseignant, stipulant que les appareils devront être rangés sous peine de sanctions, le Centre de services scolaire (CSS) des Phares choisit plutôt de sensibiliser les adultes aux réalités des plus jeunes.

C’est ce qu’indique la conseillère en communication du CSS des Phares, Zoé Ross-Lévesque.

« Les directions d’école ont sensibilisé leur personnel à éviter l’utilisation du cellulaire en présence des élèves, afin de mieux les soutenir dans ce nouveau changement de leur vie scolaire », mentionne madame Ross-Lévesque qui réitère que le règlement d’interdiction s’applique uniquement aux élèves.

Du côté du Centre de services scolaire des Monts-et-Marées, la directrice générale, Marie-Pierre Guénette, rapporte que la question sera abordée avec les directions du centre le 16 septembre prochain.

« Nous souhaitons conscientiser notre personnel à ne pas utiliser leurs cellulaires en présence d’élèves. »

Elle ajoute que le personnel de l’École secondaire Armand-Saint-Onge d’Amqui a déjà pris cette décision.

Plusieurs nouveautés à l’UQAR pour la rentrée

L’Université du Québec à Rimouski (UQAR) amorce cette semaine son trimestre d’automne 2025. Cette rentrée marquera le début de plusieurs nouveautés pour l’Université.

Le recteur de l’UQAR, François Deschênes, mentionne cependant qu’un aspect demeure le même, chaque année.

« La rentrée universitaire, dans la vie des étudiants, est toujours un moment magique. Il y a beaucoup d’énergie dans l’air, parce qu’après s’être reposé cet été, plusieurs sont de retour pour une deuxième, une troisième année d’étude et parfois même plus. Ils sont contents de retrouver leur collègue. Les nouveaux étudiants, eux, découvrent l’université et souvent c’est un moment auquel ils ont bien hâte. Il peut y avoir un stress relié à l’aspect nouveauté, mais c’est surtout un moment joyeux. »

Il ajoute que ce sentiment est aussi partagé par le personnel de l’établissement.

Plusieurs nouveautés marquantes

Du côté de ce qui est nouveau, le recteur mentionne notamment le lancement d’un nouveau baccalauréat en administration, à l’Antenne de Baie-Comeau. Il précise qu’il reste des places dans ce programme et invite les gens intéressés à s’inscrire, pendant qu’il est encore possible de le faire.

« Nous allons aussi accueillir la première cohorte du doctorat en sciences infirmières. C’est un programme conjoint avec l’Université du Québec à Chicoutimi, l’Université du Québec en Outaouais et l’Université du Québec à Trois-Rivières. Il s’agit d’une nouveauté qui nous permettra de former, carrément, la relève professorale, dans un secteur qui en a bien besoin, parce qu’en ayant les formateurs, nous aurons ensuite la possibilité de former plus d’infirmières. C’est l’objectif. »

Le lancement du doctorat en psychologie l’an dernier permet aussi à l’Université de présenter une autre nouveauté.

« Les étudiants qui faisaient partie de la première cohorte sont maintenant en deuxième année. Pour ces étudiants, nous avons mis en place une nouvelle clinique universitaire de psychologie. Elle servira à les former, eux qui vont éventuellement devenir psychologues. C’est donc un contexte de formation qui est réellement pratique et qui nous permet d’offrir des services à la population du Bas-Saint-Laurent. On fait donc d’une pierre deux coups. »

Le cheminement en gestion des opérations maritimes et de la chaîne logistique, qui s’inscrit dans le cadre du baccalauréat en administration des affaires de l’UQAR, constitue une autre nouveauté du trimestre d’automne.

Finalement, le nouveau pavillon de l’UQAR, où sera enseignée la médecine vétérinaire, sera prêt au cours de l’automne.

Une rentrée sans crise du logement

Monsieur Deschênes se réjouit du fait que la rentrée automnale de 2025 ne sera pas marquée par un manque de logements étudiants.

« Nous avons travaillé fort et nous aurons de nouvelles résidences étudiantes qui seront livrées prochainement sur la rue Notre-Dame. Nous en aurons, un peu plus tard sur la 2e rue, pour un total de 134 nouvelles places en résidence à L’UQAR. C’est sans compter le partenariat que nous avons avec UTILE, qui représente 180 places supplémentaires sur la rue Alcide-C. -Horth. Pour nous, le pire de la crise du logement pour nos étudiants est derrière nous. Nous avons de place pour les accueillir et nous en sommes bien content. »

Plus de 10 000 élèves amorcent leur année scolaire

Le Centre de services scolaire (CSS) des Phares accueille 9 301 élèves en formation générale des jeunes cette année, soit 85 de moins que pour l’année scolaire 2024-2025.

De ce nombre, 31 sont inscrits au programme passe-partout, 206 à la maternelle 4 ans, 648 à la maternelle 5 ans, 4 537 au primaire et 3 879 au secondaire.

« Les inscriptions se poursuivent également en formation générale des adultes et en formation professionnelle. Au total, ce sont plus de 10 000 élèves qui franchiront les portes de nos établissements cette année, accompagnés par des équipes-écoles engagées et mobilisées pour soutenir leur réussite », affirme la coordonnatrice aux communications pour la direction générale du CSS des Phares, Zoé Ross-Lévesque.

« Toutes nos équipes, tant dans les écoles que dans les services administratifs, ont mis tout leur cœur

à assurer un retour en classe stimulant, sécuritaire et bienveillant. Ces conditions sont essentielles à la réussite et à l’épanouissement de nos élèves. Nous tenons aussi à souligner le rôle essentiel de nos partenaires clés : les parents », ajoute la directrice générale du Centre, Nancy Prévéreault.

Nombre suffisant d’enseignants

Selon Zoé Ross-Lévesque, le recrutement d’enseignants va très bien au CSS des Phares.

« Le taux de comblement des postes d’enseignants atteint maintenant plus de 98,5 %. Il nous reste toutefois à recruter quelques spécialistes, notamment en adaptation scolaire et en éducation physique au secondaire. »

Avec l’interdiction du cellulaire à l’école, instaurée par le gouvernement provincial, le CSS compte mettre en place un climat d’apprentissage serein et propice à la concentration dans ses écoles secondaires.

« L’offre d’activités parascolaires, déjà bien ancrée dans nos milieux, continuera de permettre aux élèves de socialiser et de s’épanouir, en développant leurs talents et en nourrissant leur engagement ainsi que leur bien-être », exprime madame Ross-Lévesque.

Communications simplifiées

Les communications seront simplifiées avec le déploiement complet de l’application Clic-École dans tous les établissements primaires et secondaires.

D’autres projets éducatifs poursuivront leur lancée, dont Agrécole, Hémisphère, le programme musique-orchestre à l’école Élisabeth-Turgeon, l’école Grand Défi et le nouveau programme escalade St-Yves.

Au cours de l’été, 16 chantiers et 10 projets d’aménagement de cours d’école, dont la valeur des projets totalise 10 M$, ont été menés afin d’agrandir, de réhabiliter et d’entretenir les établissements.

En formation professionnelle, il est toujours possible de s’inscrire aux différents programmes offerts à Mont-Joli et à Rimouski. Les options disponibles sont détaillées au www.jesuispro.com.

Hydro-Québec et le gouvernement investissent ensemble pour former des travailleurs de la construction

La société d’État va débourser 100 millions $ pour financer la formation de travailleurs dont elle a directement besoin pour réaliser ses projets énergétiques.

Le gouvernement Legault va lui investir 150 millions $ pour former de nouveaux travailleurs dans des métiers de la construction «en très forte demande» – charpentier-menuisier, arpenteur, grutier et mécanicien de machinerie lourde.

Ces investissements sur trois ans doivent permettre de former au total plus de 5000 travailleurs supplémentaires pour répondre aux besoins des projets d’Hydro-Québec.

[L'article Hydro-Québec et le gouvernement investissent ensemble pour former des travailleurs de la construction a d'abord été publié dans InfoBref.]

La Rédemption : la classe de maternelle est sauvée

Placés dans l’incertitude à moins d’une semaine de la rentrée scolaire, les parents d’enfants d’âge préscolaire de La Rédemption peuvent crier victoire. Le ministère de l’Éducation autorise l’instauration d’une classe de maternelle pour les enfants de quatre et cinq ans à l’école Clair-Soleil.

Lors des inscriptions au préscolaire, en mars dernier, le nombre d’enfants était insuffisant pour ouvrir une classe dans cet établissement de La Mitis.

« La direction de l’école a alors rencontré le conseil municipal afin de les sensibiliser à l’importance de se mobiliser pour accueillir de nouvelles familles. En fin d’année scolaire, les parents avaient été informés que, faute d’un nombre suffisant d’élèves, ceux inscrits pour la prochaine année seraient accueillis à l’école de la Rivière à Sainte-Angèle. Le service de transport est offert pour ces élèves », explique la coordonnatrice aux communications pour la direction générale du Centre de services scolaire des Phares, Zoé Ross-Lévesque.

Le CSS des Phares prétend qu’au début août, le nombre d’élèves était toujours insuffisant et que quelques jours plus tard, il a reçu la confirmation d’une nouvelle inscription, portant à six le nombre d’élèves d’âge préscolaire.

« Cette nouvelle inscription permet ainsi d’atteindre le seuil requis pour ouvrir une classe de préscolaire. Nous avons transmis une demande officielle au ministère de l’Éducation dès le lendemain (mardi). Notre intérêt est d’offrir le service de préscolaire tout comme les années antérieures », indique madame Ross-Lévesque.

Mobilisation des parents

Des parents et des citoyens de La Rédemption se sont rassemblés devant l’école, mercredi, pour dénoncer cette situation.

Contrairement à ce que rapporte le CSS des Phares, Mélissa Bérubé avance que sa sœur avait inscrit son fils dès le mois de juin, ce qui portait à six le nombre d’enfants d’âge préscolaire à l’école Clair-Soleil.

« Cette semaine, le directeur de l’école a appelé les parents du préscolaire pour dire qu’une nouvelle inscription s’était ajoutée le 18 août et que nous étions à six élèves, mais nous en avions déjà six avec le fils de ma sœur. Elle l’avait inscrit le 20 juin », indique-t-elle.

Mélissa Bérubé habite l’endroit depuis toujours. Parmi ses quatre enfants, deux fréquentent déjà l’école Clair-Soleil. Ses deux autres ont présentement deux ans et six mois. Elle est inquiète pour l’avenir de l’établissement d’enseignement.

« Je veux m’impliquer pour maintenir la classe ouverte, mais aussi l’école ouverte. Ma sœur veut déménager ici avec sa petite famille. Il y a des projets de développement à La Rédemption , mais sans école, c’est difficile d’attirer des gens », dit-elle.

Sans classe de maternelle, les enfants de La Rédemption auraient été redirigés vers Sainte-Angèle, à une vingtaine de minutes de leur village.

Je Raccroche attend toujours après son financement

À deux semaines de la reprise de ses activités, le 2 septembre prochain, Je Raccroche est toujours en attente de son financement, ce qui complique la vie de ses dirigeants qui doivent puiser dans ses coffres pour payer les salaires de ses employés qui sont entrés au travail lundi pour préparer la rentrée.

Je Raccroche est un organisme de raccrochage scolaire et socioprofessionnel pour les jeunes de 16 à 30 ans qui peuvent continuer leurs études secondaires et élargir leurs connaissances sur le monde.

Tout en offrant un accompagnement et un suivi adapté à leurs besoins, Je raccroche s’échelonne d’août à juin, à raison de 30 heures par semaine, dans un local situé au Centre de formation Rimouski-Neigette. Les jeunes peuvent s’inscrire à n’importe quel moment et la durée de leur parcours dépend du temps qui leur sera nécessaire afin d’atteindre leurs objectifs.

« Le ministère ne veut pas qu’on parle de retard, disons qu’il y a des délais inhabituels dans le versement de notre financement. Lors des dernières années, on recevait notre financement à la fin de juin ou au début de juillet. Selon ce qu’on nous dit, ce ne sera pas avant la fin d’août ou le début de septembre. Nous n’avons pas reçu d’explications pour justifier le tout », commente le directeur de l’organisme, Michel Lessard.

Diminuer les heures

« Nous avons dû diminuer nos heures, la coordonnatrice et moi, pour s’assurer d’avoir assez d’argent dans le compte de fonctionnement pour les salaires des employés qui doivent se préparer pour l’arrivée des jeunes. L’ensemble de l’équipe a repris le travail mardi matin. Nous avons beaucoup de choses à préparer et les rencontres d’accueil à faire. On ne voulait pas prendre de retard. On devrait y arriver si l’argent arrive d’ici le début de septembre, mais il ne faudrait pas que ça devienne une habitude », explique le directeur.

L’organisme a reçu la confirmation du montant de son financement.

« C’est bien, mais ça ne nous donne pas d’argent pour préparer la rentrée. Je ne peux pas payer mes employés avec des promesses. Nous aurons une hausse d’une peu moins de 2%. Ce n’est pas énorme, mais c’est satisfaisant dans les circonstances. Au moins, il n’y a pas de coupures », poursuit monsieur Lessard.

Pas de local à payer

Monsieur Lessard se réjouit que l’organisme ne paye pas de local, appartenant au Centre de services scolaire des Phares.

« Une chance parce que nous devrions utiliser une marge de crédit, ce qui représente des frais dont nous ne serions pas responsables », précise-t-il.

Michel Lessard souligne avoir toujours eu une très bonne collaboration du ministère de l’Éducation, sans qui l’organisme n’existerait pas.

« On ne sait pas trop pourquoi, mais cela a pris beaucoup de temps cet été avant qu’on obtienne des réponses. Le problème, c’est qu’on ne peut pas stocker de l’argent pour prévenir ce genre de délais ».

Le Collège de Rimouski prêt pour la rentrée

Le Collège de Rimouski s’affaire à la rentrée de ses trois établissements d’enseignement, malgré un manque de financement de 2,8 M$. Effectuée ce mardi 19 août à l’Institut maritime du Québec et au Centre matapédien d’études, elle aura lieu ce lundi 25 août au Cégep de Rimouski.

Les admissions à l’enseignement régulier de ces trois composantes totalisaient, en date du vendredi 15 août, près de 2750 étudiants. Il s’agit d’une augmentation par rapport à l’an dernier.

En mai dernier, le Cégep de Rimouski apprenait qu’il devrait composer avec des compressions estimées à trois millions de dollars dans son budget 2025-2026.

Depuis, l’institution a appris que l’effort budgétaire serait plutôt de 2,8 M$, obtenant ainsi un budget de 82 M$.

Un plan en quatre temps, qui consiste en la révision des dépenses, des revenus, des processus et des dossiers et des ressources humaines, a alors été mis en œuvre.

« Malgré les enjeux budgétaires, nous avons maintenu notre carte de programme. Il n’y a donc pas d’impact sur notre offre de formation, autant du côté de la formation régulière que du côté de la formation continue. À la formation continue, nous avons même plus de cohortes que jamais, avec 35 cohortes qui seront offertes cette année », rapporte la directrice générale du Collège, Julie Gasse.

Elle ajoute que l’augmentation du nombre d’étudiants est aussi un aspect rassurant.

« Cela met en valeur l’importance de notre Cégep. On voit que c’est un pôle d’attraction qui permet de maintenir nos jeunes en région. On répond à ce besoin et c’est très motivant. Aussi, on accueille une deuxième cohorte d’infirmières qualifiées à l’international. Nous aurons encore une fois la chance d’accueillir ces étudiants qui sont qualifiés comme infirmiers ailleurs, mais qui doivent satisfaire les exigences de l’Ordre des infirmières et infirmiers du Québec », indique madame Gasse.

Nouveau plan stratégique

L’année 2025-2026 correspond également à la première année de mise en œuvre du nouveau plan stratégique du Collège.

« Nous l’avons adopté en mars dernier. Il s’agit d’un plan qui se tient de 2025 à 2030 pour nos trois composantes. On pourra donc suivre nos orientations. »

Le Collège poursuit aussi son carnet de festivités. Le Centre matapédien d’études collégiales va souligner ses 30 ans d’existence, tandis que le Cégep de Rimouski conclura les fêtes du centenaire de son pavillon principal.

Québec a publié des lignes directrices sur l’IA pour les cégeps et les universités

Le gouvernement Legault a dévoilé deux documents qui visent à guider le réseau de l’enseignement supérieur dans l’intégration et l’utilisation de l’intelligence artificielle.

Un cadre de référence

Le premier document détaille les principes directeurs et les orientations issus des travaux de l’Instance de concertation nationale sur l’IA en enseignement supérieur.

Un guide pratique

Le second document présente aux établissements des exemples concrets pour leur permettre d’établir leur propre gouvernance en IA.

[L'article Québec a publié des lignes directrices sur l’IA pour les cégeps et les universités a d'abord été publié dans InfoBref.]

Matane : nouvelle école primaire de 61 M$

Une nouvelle école primaire verra le jour à Matane, au coût de 61 M$, d’ici 2030. Le Centre de services scolaire Monts-et-Marées (CSSMM) a confirmé que le ministère de l’Éducation avait répondu favorablement à sa demande pour bâtir une nouvelle école primaire capable d’accueillir une trentaine de classes.

Ce projet de nouvelle école remplacera les écoles Zénon-Soucy et Victor-Côté qui arrivent en fin de vie utile.

Selon le Centre de services scolaire Monts-et-Marées, les deux établissements d’enseignement qui ont, chacun, respectivement 72 et 76 ans nécessitent des travaux majeurs estimés à plusieurs millions de dollars. Il en aurait coûté davantage pour restaurer les deux bâtiments existants.

Devant ce constat, le CSSMM avait décidé de déposer un projet au ministère de l’Éducation.

Maintenant que cette étape est complétée, le CSSMMM devra embaucher une firme d’experts pour réaliser les plans et devis.

Il y aura aussi des discussions avec la Ville de Matane, la MRC de La Matanie et le député provincial, Pascal Bérubé, afin de déterminer où ce nouvel établissement d’enseignement sera construit.

Si tout se déroule comme prévu, les travaux débuteraient dès 2026 et les élèves intégreraient la nouvelle école pour la rentrée 2029-2030.

Retour à l’école VIP : 250 sacs de matériel scolaire remis

L’organisme Retour à l’école VIP (REVIP) tenait, ce samedi 16 août en après-midi, sa huitième fête de remise. Au cours de cette fête, 250 élèves du primaire ont pu recevoir un sac d’école contenant tout le matériel scolaire nécessaire pour l’année à venir.

L’événement, qui se tient annuellement depuis 2018, vise à venir en aide aux familles de la région qui sont dans le besoin.

Il s’agit d’une initiative de deux églises rimouskoises : l’Alliance Chrétienne et Missionnaire de Rimouski et l’Église Connexion.

Plus de demandes, mais moins de moyens

Bien que l’organisme ait reçu des demandes pour 325 sacs d’école en 2025, un manque de ressources financières ne lui a pas permis de répondre à l’ensemble des besoins.

« Les gens qui veulent contribuer à la mission de l’organisme peuvent se rendre directement sur notre site web, retourecolevip.org, pour y faire un don. On recueille les dons de monsieur et madame tout le monde, mais aussi les dons des entreprises, pour qui nous pouvons remettre un reçu pour les impôts », explique Sully Reichenbach qui est membre du comité organisateur de REVIP depuis ses débuts dans Rimouski.

Même si la fête de remise a déjà eu lieu, il est encore possible de contribuer, puisque l’organisme s’affaire toute l’année à l’achat de fournitures scolaire.

« Quand il y a des spéciaux, on va magasiner, donc nous n’avons pas seulement besoin de dons l’été. L’an prochain, nous pourrons peut-être accepter les demandes de plus d’enfants, si nous avons plus de ressources pour le faire », espère madame Reichenbach.

Événement festif

Malgré tout, le cœur était à la fête en ce samedi après-midi. Fidèle à son habitude, l’organisme a mis à la disposition des familles des stations de jeux et des jeux gonflables pour leur permettre de s’amuser lors de cette fête de remise.

L’équipe a aussi élaboré quelques nouveautés pour l’édition 2025.

« Nous avons mis sur pied un magasin général VIP. Les enfants, en faisant des stations, accumulent des points. Après, ils peuvent tourner la roulette. On a fait cet ajout parce que notre organisme se nomme Retour à l’École VIP, donc on s’est dit qu’on pourrait aussi avoir des articles VIP. Ce sont donc de petits articles scolaires plus « cool » que les enfants pourront ajouter à leur sac. »

Une autre nouveauté est l’aménagement d’une table de surplus.

« Ça fait sept ans qu’on fait l’achat de fournitures scolaires, alors au fil des années, il y a des articles que nous avons accumulés et qui ne vont pas dans les sacs. Les gens qui participent à la Fête de remise peuvent donc se servir : tout est à donner. »

Il manque plus de 4000 enseignants

À deux semaines de la rentrée scolaire, le ministère de l’éducation a annoncé qu’en date du 11 août, plus de 4115 postes d’enseignants étaient encore vacants (plus de la moitié de ces postes sont à temps partiel).

Pour comparaison, à la même période, le nombre de postes vacants était de:

- 5700 l’an dernier;

- 8500 en 2023.

La baisse du nombre de postes à combler s’explique en partie par le fait que le gouvernement demande depuis l’an dernier aux centres de services scolaires de terminer plus tôt l’affectation des enseignants à leur poste pour l’année scolaire.

[L'article Il manque plus de 4000 enseignants a d'abord été publié dans InfoBref.]

Leading Ukrainian historian Plokhii steps down from top Harvard post after 12 years

Serhii Plokhii, a renowned scholar of Ukrainian history, is stepping down as director of the Ukrainian Research Institute at Harvard University (HURI) after 12 years of leadership, the institute announced on June 30.

"It has been a privilege and an honor to lead the Institute over the past 12 years," Plokhii said in a farewell message.

Plokhii is one of the leading experts on the history of Eastern Europe. Born to a Ukrainian family in Russia, he has lived in Ukraine for 35 years and has written several best-selling books on the subject, including "The Gates of Europe: A History of Ukraine" and "The Last Empire: The Final Days of the Soviet Union."

Plokhii expressed gratitude to colleagues, staff, and supporters and offered best wishes to historian Terry Martin, who will assume the role of director in the upcoming academic year.

"Years marked by the anxiety and challenges of war, but also by the opportunities that institutions like HURI offer to advance what Harvard’s motto calls 'good knowledge' about Ukraine and the region."

The Ukrainian Research Institute, founded in 1973 through the support of the Ukrainian-American community, is the leading academic institution in the United States focused on Ukrainian studies.

Based at Harvard, HURI promotes research and scholarship on Ukraine's history, culture, and politics through fellowships, conferences, digital initiatives, and its flagship journal, Harvard Ukrainian Studies.

Under Plokhii's leadership, the Institute expanded its programming significantly, including the establishment of the Temerty Contemporary Ukraine Program in 2019, an initiative that became central to HURI's academic response following Russia's full-scale invasion of Ukraine in 2022.

The incoming director, Martin, is a scholar of Soviet history and professor of Russian studies.

The Kyiv IndependentFrancis Farrell

The Kyiv IndependentFrancis Farrell

IA et éducation (2/2) : du dilemme moral au malaise social

Suite de notre dossier sur IA et éducation (voir la première partie).

La bataille éducative est-elle perdue ?

Une grande enquête de 404 media montre qu’à l’arrivée de ChatGPT, les écoles publiques américaines étaient totalement démunies face à l’adoption généralisée de ChatGPT par les élèves. Le problème est d’ailleurs loin d’être résolu. Le New York Mag a récemment publié un article qui se désole de la triche généralisée qu’ont introduit les IA génératives à l’école. De partout, les élèves utilisent les chatbots pour prendre des notes pendant les cours, pour concevoir des tests, résumer des livres ou des articles, planifier et rédiger leurs essais, résoudre les exercices qui leurs sont demandés. Le plafond de la triche a été pulvérisé, explique un étudiant. “Un nombre considérable d’étudiants sortiront diplômés de l’université et entreront sur le marché du travail en étant essentiellement analphabètes”, se désole un professeur qui constate le court-circuitage du processus même d’apprentissage. La triche semblait pourtant déjà avoir atteint son apogée, avant l’arrivée de ChatGPT, notamment avec les plateformes d’aides au devoir en ligne comme Chegg et Course Hero. “Pour 15,95 $ par mois, Chegg promettait des réponses à toutes les questions de devoirs en seulement 30 minutes, 24h/24 et 7j/7, grâce aux 150 000 experts diplômés de l’enseignement supérieur qu’elle employait, principalement en Inde”.

Chaque école a proposé sa politique face à ces nouveaux outils, certains prônant l’interdiction, d’autres non. Depuis, les politiques se sont plus souvent assouplies, qu’endurcies. Nombre de profs autorisent l’IA, à condition de la citer, ou ne l’autorisent que pour aide conceptuelle et en demandant aux élèves de détailler la manière dont ils l’ont utilisé. Mais cela ne dessine pas nécessairement de limites claires à leurs usages. L’article souligne que si les professeurs se croient doués pour détecter les écrits générés par l’IA, des études ont démontré qu’ils ne le sont pas. L’une d’elles, publiée en juin 2024, utilisait de faux profils d’étudiants pour glisser des travaux entièrement générés par l’IA dans les piles de correction des professeurs d’une université britannique. Les professeurs n’ont pas signalé 97 % des essais génératifs. En fait, souligne l’article, les professeurs ont plutôt abandonné l’idée de pouvoir détecter le fait que les devoirs soient rédigés par des IA. “De nombreux enseignants semblent désormais désespérés”. “Ce n’est pas ce pour quoi nous nous sommes engagés”, explique l’un d’entre eux. La prise de contrôle de l’enseignement par l’IA tient d’une crise existentielle de l’éducation. Désormais, les élèves ne tentent même plus de se battre contre eux-mêmes. Ils se replient sur la facilité. “Toute tentative de responsabilisation reste vaine”, constatent les professeurs.

L’IA a mis à jour les défaillances du système éducatif. Bien sûr, l’idéal de l’université et de l’école comme lieu de développement intellectuel, où les étudiants abordent des idées profondes a disparu depuis longtemps. La perspective que les IA des professeurs évaluent désormais les travaux produits par les IA des élèves, finit de réduire l’absurdité de la situation, en laissant chacun sans plus rien à apprendre. Plusieurs études (comme celle de chercheurs de Microsoft) ont établi un lien entre l’utilisation de l’IA et une détérioration de l’esprit critique. Pour le psychologue, Robert Sternberg, l’IA générative compromet déjà la créativité et l’intelligence. “La bataille est perdue”, se désole un autre professeur.

Reste à savoir si l’usage “raisonnable” de l’IA est possible. Dans une longue enquête pour le New Yorker, le journaliste Hua Hsu constate que tous les étudiants qu’il a interrogé pour comprendre leur usage de l’IA ont commencé par l’utiliser pour se donner des idées, en promettant de veiller à un usage responsable et ont très vite basculé vers des usages peu modérés, au détriment de leur réflexion. L’utilisation judicieuse de l’IA ne tient pas longtemps. Dans un rapport sur l’usage de Claude par des étudiants, Anthropic a montré que la moitié des interactions des étudiants avec son outil serait extractive, c’est-à-dire servent à produire des contenus. 404 media est allé discuter avec les participants de groupes de soutien en ligne de gens qui se déclarent comme “dépendants à l’IA”. Rien n’est plus simple que de devenir accro à un chatbot, confient des utilisateurs de tout âge. OpenAI en est conscient, comme le pointait une étude du MIT sur les utilisateurs les plus assidus, sans proposer pourtant de remèdes.

Comment apprendre aux enfants à faire des choses difficiles ? Le journaliste Clay Shirky, devenu responsable de l’IA en éducation à la New York University, dans le Chronicle of Higher Education, s’interroge : l’IA améliore-t-elle l’éducation ou la remplace-t-elle ? “Chaque année, environ 15 millions d’étudiants de premier cycle aux États-Unis produisent des travaux et des examens de plusieurs milliards de mots. Si le résultat d’un cours est constitué de travaux d’étudiants (travaux, examens, projets de recherche, etc.), le produit de ce cours est l’expérience étudiante”. Un devoir n’a de valeur que ”pour stimuler l’effort et la réflexion de l’élève”. “L’utilité des devoirs écrits repose sur deux hypothèses : la première est que pour écrire sur un sujet, l’élève doit comprendre le sujet et organiser ses pensées. La seconde est que noter les écrits d’un élève revient à évaluer l’effort et la réflexion qui y ont été consacrés”. Avec l’IA générative, la logique de cette proposition, qui semblait pourtant à jamais inébranlable, s’est complètement effondrée.

Pour Shirky, il ne fait pas de doute que l’IA générative peut être utile à l’apprentissage. “Ces outils sont efficaces pour expliquer des concepts complexes, proposer des quiz pratiques, des guides d’étude, etc. Les étudiants peuvent rédiger un devoir et demander des commentaires, voir à quoi ressemble une réécriture à différents niveaux de lecture, ou encore demander un résumé pour vérifier la clarté”… “Mais le fait que l’IA puisse aider les étudiants à apprendre ne garantit pas qu’elle le fera”. Pour le grand théoricien de l’éducation, Herbert Simon, “l’enseignant ne peut faire progresser l’apprentissage qu’en incitant l’étudiant à apprendre”. “Face à l’IA générative dans nos salles de classe, la réponse évidente est d’inciter les étudiants à adopter les utilisations utiles de l’IA tout en les persuadant d’éviter les utilisations néfastes. Notre problème est que nous ne savons pas comment y parvenir”, souligne pertinemment Shirky. Pour lui aussi, aujourd’hui, les professeurs sont en passe d’abandonner. Mettre l’accent sur le lien entre effort et apprentissage ne fonctionne pas, se désole-t-il. Les étudiants eux aussi sont déboussolés et finissent par se demander où l’utilisation de l’IA les mène. Shirky fait son mea culpa. L’utilisation engagée de l’IA conduit à son utilisation paresseuse. Nous ne savons pas composer avec les difficultés. Mais c’était déjà le cas avant ChatGPT. Les étudiants déclarent régulièrement apprendre davantage grâce à des cours magistraux bien présentés qu’avec un apprentissage plus actif, alors que de nombreuses études démontrent l’inverse. “Un outil qui améliore le rendement mais dégrade l’expérience est un mauvais compromis”.

C’est le sens même de l’éducation qui est en train d’être perdu. Le New York Times revenait récemment sur le fait que certaines écoles interdisent aux élèves d’utiliser ces outils, alors que les professeurs, eux, les surutilisent. Selon une étude auprès de 1800 enseignants de l’enseignement supérieur, 18 % déclaraient utiliser fréquemment ces outils pour faire leur cours, l’année dernière – un chiffre qui aurait doublé depuis. Les étudiants ne lisent plus ce qu’ils écrivent et les professeurs non plus. Si les profs sont prompts à critiquer l’usage de l’IA par leurs élèves, nombre d’entre eux l’apprécient pour eux-mêmes, remarque un autre article du New York Times. A PhotoMath ou Google Lens qui viennent aider les élèves, répondent MagicSchool et Brisk Teaching qui proposent déjà des produits d’IA qui fournissent un retour instantané sur les écrits des élèves. L’Etat du Texas a signé un contrat de 5 ans avec l’entreprise Cambium Assessment pour fournir aux professeurs un outil de notation automatisée des écrits des élèves.

Pour Jason Koebler de 404 media : “la société dans son ensemble n’a pas très bien résisté à l’IA générative, car les grandes entreprises technologiques s’obstinent à nous l’imposer. Il est donc très difficile pour un système scolaire public sous-financé de contrôler son utilisation”. Pourtant, peu après le lancement public de ChatGPT, certains districts scolaires locaux et d’État ont fait appel à des consultants pro-IA pour produire des formations et des présentations “encourageant largement les enseignants à utiliser l’IA générative en classe”, mais “aucun n’anticipait des situations aussi extrêmes que celles décrites dans l’article du New York Mag, ni aussi problématiques que celles que j’ai entendues de mes amis enseignants, qui affirment que certains élèves désormais sont totalement dépendants de ChatGPT”. Les documents rassemblés par 404media montrent surtout que les services d’éducation américains ont tardé à réagir et à proposer des perspectives aux enseignants sur le terrain.

Dans un autre article de 404 media, Koebler a demandé à des professeurs américains d’expliquer ce que l’IA a changé à leur travail. Les innombrables témoignages recueillis montrent que les professeurs ne sont pas restés les bras ballants, même s’ils se sentent très dépourvus face à l’intrusion d’une technologie qu’ils n’ont pas voulu. Tous expliquent qu’ils passent des heures à corriger des devoirs que les élèves mettent quelques secondes à produire. Tous dressent un constat similaire fait d’incohérences, de confusions, de démoralisations, entre préoccupations et exaspérations. Quelles limites mettre en place ? Comment s’assurer qu’elles soient respectées ? “Je ne veux pas que les étudiants qui n’utilisent pas de LLM soient désavantagés. Et je ne veux pas donner de bonnes notes à des étudiants qui ne font pratiquement rien”, témoigne un prof. Beaucoup ont désormais recours à l’écriture en classe, au papier. Quelques-uns disent qu’ils sont passés de la curiosité au rejet catégorique de ces outils. Beaucoup pointent que leur métier est plus difficile que jamais. “ChatGPT n’est pas un problème isolé. C’est le symptôme d’un paradigme culturel totalitaire où la consommation passive et la régurgitation de contenu deviennent le statu quo.”

L’IA place la déqualification au coeur de l’apprentissage

Nicholas Carr, qui vient de faire paraître Superbloom : How Technologies of Connection Tear Us Apart (Norton, 2025, non traduit) rappelle dans sa newsletter que “la véritable menace que représente l’IA pour l’éducation n’est pas qu’elle encourage la triche, mais qu’elle décourage l’apprentissage”. Pour Carr, lorsque les gens utilisent une machine pour réaliser une tâche, soit leurs compétences augmentent, soit elles s’atrophient, soit elles ne se développent jamais. C’est la piste qu’il avait d’ailleurs exploré dans Remplacer l’humain (L’échapée, 2017, traduction de The Glass Cage) en montrant comment les logiciels transforment concrètement les métiers, des architectes aux pilotes d’avions). “Si un travailleur maîtrise déjà l’activité à automatiser, la machine peut l’aider à développer ses compétences” et relever des défis plus complexes. Dans les mains d’un mathématicien, une calculatrice devient un “amplificateur d’intelligence”. A l’inverse, si le maintien d’une compétence exige une pratique fréquente, combinant dextérité manuelle et mentale, alors l’automatisation peut menacer le talent même de l’expert. C’est le cas des pilotes d’avion confrontés aux systèmes de pilotage automatique qui connaissent un “affaissement des compétences” face aux situations difficiles. Mais l’automatisation est plus pernicieuse encore lorsqu’une machine prend les commandes d’une tâche avant que la personne qui l’utilise n’ait acquis l’expérience de la tâche en question. “C’est l’histoire du phénomène de « déqualification » du début de la révolution industrielle. Les artisans qualifiés ont été remplacés par des opérateurs de machines non qualifiés. Le travail s’est accéléré, mais la seule compétence acquise par ces opérateurs était celle de faire fonctionner la machine, ce qui, dans la plupart des cas, n’était quasiment pas une compétence. Supprimez la machine, et le travail s’arrête”.

Bien évidemment que les élèves qui utilisent des chatbots pour faire leurs devoirs font moins d’effort mental que ceux qui ne les utilisent pas, comme le pointait une très épaisse étude du MIT (synthétisée par Le Grand Continent), tout comme ceux qui utilisent une calculatrice plutôt que le calcul mental vont moins se souvenir des opérations qu’ils ont effectuées. Mais le problème est surtout que ceux qui les utilisent sont moins méfiants de leurs résultats (comme le pointait l’étude des chercheurs de Microsoft), alors que contrairement à ceux d’une calculatrice, ils sont beaucoup moins fiables. Le problème de l’usage des LLM à l’école, c’est à la fois qu’il empêche d’apprendre à faire, mais plus encore que leur usage nécessite des compétences pour les évaluer.

L’IA générative étant une technologie polyvalente permettant d’automatiser toutes sortes de tâches et d’emplois, nous verrons probablement de nombreux exemples de chacun des trois scénarios de compétences dans les années à venir, estime Carr. Mais l’utilisation de l’IA par les lycéens et les étudiants pour réaliser des travaux écrits, pour faciliter ou éviter le travail de lecture et d’écriture, constitue un cas particulier. “Elle place le processus de déqualification au cœur de l’éducation. Automatiser l’apprentissage revient à le subvertir”.

En éducation, plus vous effectuez de recherches, plus vous vous améliorez en recherche, et plus vous rédigez d’articles, plus vous améliorez votre rédaction. “Cependant, la valeur pédagogique d’un devoir d’écriture ne réside pas dans le produit tangible du travail – le devoir rendu à la fin du devoir. Elle réside dans le travail lui-même : la lecture critique des sources, la synthèse des preuves et des idées, la formulation d’une thèse et d’un argument, et l’expression de la pensée dans un texte cohérent. Le devoir est un indicateur que l’enseignant utilise pour évaluer la réussite du travail de l’étudiant – le travail d’apprentissage. Une fois noté et rendu à l’étudiant, le devoir peut être jeté”.

L’IA générative permet aux étudiants de produire le produit sans effectuer le travail. Le travail remis par un étudiant ne témoigne plus du travail d’apprentissage qu’il a nécessité. “Il s’y substitue ». Le travail d’apprentissage est ardu par nature : sans remise en question, l’esprit n’apprend rien. Les étudiants ont toujours cherché des raccourcis bien sûr, mais l’IA générative est différente, pas son ampleur, par sa nature. “Sa rapidité, sa simplicité d’utilisation, sa flexibilité et, surtout, sa large adoption dans la société rendent normal, voire nécessaire, l’automatisation de la lecture et de l’écriture, et l’évitement du travail d’apprentissage”. Grâce à l’IA générative, un élève médiocre peut produire un travail remarquable tout en se retrouvant en situation de faiblesse. Or, pointe très justement Carr, “la conséquence ironique de cette perte d’apprentissage est qu’elle empêche les élèves d’utiliser l’IA avec habileté. Rédiger une bonne consigne, un prompt efficace, nécessite une compréhension du sujet abordé. Le dispensateur doit connaître le contexte de la consigne. Le développement de cette compréhension est précisément ce que la dépendance à l’IA entrave”. “L’effet de déqualification de l’outil s’étend à son utilisation”. Pour Carr, “nous sommes obnubilés par la façon dont les étudiants utilisent l’IA pour tricher. Alors que ce qui devrait nous préoccuper davantage, c’est la façon dont l’IA trompe les étudiants”.

Nous sommes d’accord. Mais cette conclusion n’aide pas pour autant à avancer !

Passer du malaise moral au malaise social !

Utiliser ou non l’IA semble surtout relever d’un malaise moral (qui en rappelle un autre), révélateur, comme le souligne l’obsession sur la « triche » des élèves. Mais plus qu’un dilemme moral, peut-être faut-il inverser notre regard, et le poser autrement : comme un malaise social. C’est la proposition que fait le sociologue Bilel Benbouzid dans un remarquable article pour AOC (première et seconde partie).

Pour Benbouzid, l’IA générative à l’université ébranle les fondements de « l’auctorialité », c’est-à-dire qu’elle modifie la position d’auteur et ses repères normatifs et déontologiques. Dans le monde de l’enseignement supérieur, depuis le lancement de ChatGPT, tout le monde s’interroge pour savoir que faire de ces outils, souvent dans un choix un peu binaire, entre leur autorisation et leur interdiction. Or, pointe justement Benbouzid, l’usage de l’IA a été « perçu » très tôt comme une transgression morale. Très tôt, les utiliser a été associé à de la triche, d’autant qu’on ne peut pas les citer, contrairement à tout autre matériel écrit.

Face à leur statut ambiguë, Benbouzid pose une question de fond : quelle est la nature de l’effort intellectuel légitime à fournir pour ses études ? Comment distinguer un usage « passif » de l’IA d’un usage « actif », comme l’évoquait Ethan Mollick dans la première partie de ce dossier ? Comment contrôler et s’assurer d’une utilisation active et éthique et non pas passive et moralement condamnable ?

Pour Benbouzid, il se joue une réflexion éthique sur le rapport à soi qui nécessite d’être authentique. Mais peut-on être authentique lorsqu’on se construit, interroge le sociologue, en évoquant le fait que les étudiants doivent d’abord acquérir des compétences avant de s’individualiser. Or l’outil n’est pas qu’une machine pour résumer ou copier. Pour Benbouzid, comme pour Mollick, bien employée, elle peut-être un vecteur de stimulation intellectuelle, tout en exerçant une influence diffuse mais réelle. « Face aux influences tacites des IAG, il est difficile de discerner les lignes de partage entre l’expression authentique de soi et les effets normatifs induits par la machine. » L’enjeu ici est bien celui de la capacité de persuasion de ces machines sur ceux qui les utilisent.

Pour les professeurs de philosophie et d’éthique Mark Coeckelbergh et David Gunkel, comme ils l’expliquent dans un article (qui a depuis donné lieu à un livre, Communicative AI, Polity, 2025), l’enjeu n’est pourtant plus de savoir qui est l’auteur d’un texte (même si, comme le remarque Antoine Compagnon, sans cette figure, la lecture devient indéchiffrable, puisque nul ne sait plus qui parle, ni depuis quels savoirs), mais bien plus de comprendre les effets que les textes produisent. Pourtant, ce déplacement, s’il est intéressant (et peut-être peu adapté à l’IA générative, tant les textes produits sont rarement pertinents), il ne permet pas de cadrer les usages des IA génératives qui bousculent le cadre ancien de régulation des textes académiques. Reste que l’auteur d’un texte doit toujours en répondre, rappelle Benbouzid, et c’est désormais bien plus le cas des étudiants qui utilisent l’IA que de ceux qui déploient ces systèmes d’IA. L’autonomie qu’on attend d’eux est à la fois un idéal éducatif et une obligation morale envers soi-même, permettant de développer ses propres capacités de réflexion. « L’acte d’écriture n’est pas un simple exercice technique ou une compétence instrumentale. Il devient un acte de formation éthique ». Le problème, estiment les professeurs de philosophie Timothy Aylsworth et Clinton Castro, dans un article qui s’interroge sur l’usage de ChatGPT, c’est que l’autonomie comme finalité morale de l’éducation n’est pas la même que celle qui permet à un étudiant de décider des moyens qu’il souhaite mobiliser pour atteindre son but. Pour Aylsworth et Castro, les étudiants ont donc obligation morale de ne pas utiliser ChatGPT, car écrire soi-même ses textes est essentiel à la construction de son autonomie. Pour eux, l’école doit imposer une morale de la responsabilité envers soi-même où écrire par soi-même n’est pas seulement une tâche scolaire, mais également un moyen d’assurer sa dignité morale. « Écrire, c’est penser. Penser, c’est se construire. Et se construire, c’est honorer l’humanité en soi. »

Pour Benbouzid, les contradictions de ces deux dilemmes résument bien le choix cornélien des étudiants et des enseignants. Elle leur impose une liberté de ne pas utiliser. Mais cette liberté de ne pas utiliser, elle, ne relève-t-elle pas d’abord et avant tout d’un jugement social ?

L’IA générative ne sera pas le grand égalisateur social !

C’est la piste fructueuse qu’explore Bilel Benbouzid dans la seconde partie de son article. En explorant qui à recours à l’IA et pourquoi, le sociologue permet d’entrouvrir une autre réponse que la réponse morale. Ceux qui promeuvent l’usage de l’IA pour les étudiants, comme Ethan Mollick, estiment que l’IA pourrait agir comme une égaliseur de chances, permettant de réduire les différences cognitives entre les élèves. C’est là une référence aux travaux d’Erik Brynjolfsson, Generative AI at work, qui souligne que l’IA diminue le besoin d’expérience, permet la montée en compétence accélérée des travailleurs et réduit les écarts de compétence des travailleurs (une théorie qui a été en partie critiquée, notamment parce que ces avantages sont compensés par l’uniformisation des pratiques et leur surveillance – voir ce que nous en disions en mobilisant les travaux de David Autor). Mais sommes-nous confrontés à une homogénéisation des performances d’écritures ? N’assiste-t-on pas plutôt à un renforcement des inégalités entre les meilleurs qui sauront mieux que d’autres tirer partie de l’IA générative et les moins pourvus socialement ?

Pour John Danaher, l’IA générative pourrait redéfinir pas moins que l’égalité, puisque les compétences traditionnelles (rédaction, programmation, analyses…) permettraient aux moins dotés d’égaler les meilleurs. Pour Danaher, le risque, c’est que l’égalité soit alors reléguée au second plan : « d’autres valeurs comme l’efficacité économique ou la liberté individuelle prendraient le dessus, entraînant une acceptation accrue des inégalités. L’efficacité économique pourrait être mise en avant si l’IA permet une forte augmentation de la productivité et de la richesse globale, même si cette richesse est inégalement répartie. Dans ce scénario, plutôt que de chercher à garantir une répartition équitable des ressources, la société pourrait accepter des écarts grandissants de richesse et de statut, tant que l’ensemble progresse. Ce serait une forme d’acceptation de l’inégalité sous prétexte que la technologie génère globalement des bénéfices pour tous, même si ces bénéfices ne sont pas partagés de manière égale. De la même manière, la liberté individuelle pourrait être privilégiée si l’IA permet à chacun d’accéder à des outils puissants qui augmentent ses capacités, mais sans garantir que tout le monde en bénéficie de manière équivalente. Certains pourraient considérer qu’il est plus important de laisser les individus utiliser ces technologies comme ils le souhaitent, même si cela crée de nouvelles hiérarchies basées sur l’usage différencié de l’IA ». Pour Danaher comme pour Benbouzid, l’intégration de l’IA dans l’enseignement doit poser la question de ses conséquences sociales !

Les LLM ne produisent pas un langage neutre mais tendent à reproduire les « les normes linguistiques dominantes des groupes sociaux les plus favorisés », rappelle Bilel Benbouzid. Une étude comparant les lettres de motivation d’étudiants avec des textes produits par des IA génératives montre que ces dernières correspondent surtout à des productions de CSP+. Pour Benbouzid, le risque est que la délégation de l’écriture à ces machines renforce les hiérarchies existantes plus qu’elles ne les distribue. D’où l’enjeu d’une enquête en cours pour comprendre l’usage de l’IA générative des étudiants et leur rapport social au langage.

Les premiers résultats de cette enquête montrent par exemple que les étudiants rechignent à copier-collé directement le texte créé par les IA, non seulement par peur de sanctions, mais plus encore parce qu’ils comprennent que le ton et le style ne leur correspondent pas. « Les étudiants comparent souvent ChatGPT à l’aide parentale. On comprend que la légitimité ne réside pas tant dans la nature de l’assistance que dans la relation sociale qui la sous-tend. Une aide humaine, surtout familiale, est investie d’une proximité culturelle qui la rend acceptable, voire valorisante, là où l’assistance algorithmique est perçue comme une rupture avec le niveau académique et leur propre maîtrise de la langue ». Et effectivement, la perception de l’apport des LLM dépend du capital culturel des étudiants. Pour les plus dotés, ChatGPT est un outil utilitaire, limité voire vulgaire, qui standardise le langage. Pour les moins dotés, il leur permet d’accéder à des éléments de langages valorisés et valorisants, tout en l’adaptant pour qu’elle leur corresponde socialement.

Dans ce rapport aux outils de génération, pointe un rapport social à la langue, à l’écriture, à l’éducation. Pour Benbouzid, l’utilisation de l’IA devient alors moins un problème moral qu’un dilemme social. « Ces pratiques, loin d’être homogènes, traduisent une appropriation différenciée de l’outil en fonction des trajectoires sociales et des attentes symboliques qui structurent le rapport social à l’éducation. Ce qui est en jeu, finalement, c’est une remise en question de la manière dont les étudiants se positionnent socialement, lorsqu’ils utilisent les robots conversationnels, dans les hiérarchies culturelles et sociales de l’université. » En fait, les étudiants utilisent les outils non pas pour se dépasser, comme l’estime Mollick, mais pour produire un contenu socialement légitime. « En déléguant systématiquement leurs compétences de lecture, d’analyse et d’écriture à ces modèles, les étudiants peuvent contourner les processus essentiels d’intériorisation et d’adaptation aux normes discursives et épistémologiques propres à chaque domaine. En d’autres termes, l’étudiant pourrait perdre l’occasion de développer authentiquement son propre capital culturel académique, substitué par un habitus dominant produit artificiellement par l’IA. »

L’apparence d’égalité instrumentale que permettent les LLM pourrait donc paradoxalement renforcer une inégalité structurelle accrue. Les outils creusant l’écart entre des étudiants qui ont déjà internalisé les normes dominantes et ceux qui les singent. Le fait que les textes générés manquent d’originalité et de profondeur critique, que les IA produisent des textes superficiels, ne rend pas tous les étudiants égaux face à ces outils. D’un côté, les grandes écoles renforcent les compétences orales et renforcent leurs exigences d’originalité face à ces outils. De l’autre, d’autres devront y avoir recours par nécessité. « Pour les mieux établis, l’IA représentera un outil optionnel d’optimisation ; pour les plus précaires, elle deviendra une condition de survie dans un univers concurrentiel. Par ailleurs, même si l’IA profitera relativement davantage aux moins qualifiés, cette amélioration pourrait simultanément accentuer une forme de dépendance technologique parmi les populations les plus défavorisées, creusant encore le fossé avec les élites, mieux armées pour exercer un discernement critique face aux contenus générés par les machines ».

Bref, loin de l’égalisation culturelle que les outils permettraient, le risque est fort que tous n’en profitent pas d’une manière égale. On le constate très bien ailleurs. Le fait d’être capable de rédiger un courrier administratif est loin d’être partagé. Si ces outils améliorent les courriers des moins dotés socialement, ils ne renversent en rien les différences sociales. C’est le même constat qu’on peut faire entre ceux qui subliment ces outils parce qu’ils les maîtrisent finement, et tous les autres qui ne font que les utiliser, comme l’évoquait Gregory Chatonsky, en distinguant les utilisateurs mémétiques et les utilisateurs productifs. Ces outils, qui se présentent comme des outils qui seraient capables de dépasser les inégalités sociales, risquent avant tout de mieux les amplifier. Plus que de permettre de personnaliser l’apprentissage, pour s’adapter à chacun, il semble que l’IA donne des superpouvoirs d’apprentissage à ceux qui maîtrisent leurs apprentissages, plus qu’aux autres.

L’IApocalypse scolaire, coincée dans le droit

Les questions de l’usage de l’IA à l’école que nous avons tenté de dérouler dans ce dossier montrent l’enjeu à débattre d’une politique publique d’usage de l’IA générative à l’école, du primaire au supérieur. Mais, comme le montre notre enquête, toute la communauté éducative est en attente d’un cadre. En France, on attend les recommandations de la mission confiée à François Taddéi et Sarah Cohen-Boulakia sur les pratiques pédagogiques de l’IA dans l’enseignement supérieur, rapportait le Monde.

Un premier cadre d’usage de l’IA à l’école vient pourtant d’être publié par le ministère de l’Education nationale. Autant dire que ce cadrage processuel n’est pas du tout à la hauteur des enjeux. Le document consiste surtout en un rappel des règles et, pour l’essentiel, elles expliquent d’abord que l’usage de l’IA générative est contraint si ce n’est impossible, de fait. « Aucun membre du personnel ne doit demander aux élèves d’utiliser des services d’IA grand public impliquant la création d’un compte personnel » rappelle le document. La note recommande également de ne pas utiliser l’IA générative avec les élèves avant la 4e et souligne que « l’utilisation d’une intelligence artificielle générative pour réaliser tout ou partie d’un devoir scolaire, sans autorisation explicite de l’enseignant et sans qu’elle soit suivie d’un travail personnel d’appropriation à partir des contenus produits, constitue une fraude ». Autant dire que ce cadre d’usage ne permet rien, sinon l’interdiction. Loin d’être un cadre de développement ouvert à l’envahissement de l’IA, comme s’en plaint le SNES-FSU, le document semble surtout continuer à produire du déni, tentant de rappeler des règles sur des usages qui les débordent déjà très largement.

Sur Linked-in, Yann Houry, prof dans un Institut privé suisse, était très heureux de partager sa recette pour permettre aux profs de corriger des copies avec une IA en local, rappelant que pour des questions de légalité et de confidentialité, les professeurs ne devraient pas utiliser les services d’IA génératives en ligne pour corriger les copies. Dans les commentaires, nombreux sont pourtant venu lui signaler que cela ne suffit pas, rappelant qu’utiliser l’IA pour corriger les copies, donner des notes et classer les élèves peut-être classée comme un usage à haut-risque selon l’IA Act, ou encore qu’un formateur qui utiliserait l’IA en ce sens devrait en informer les apprenants afin qu’ils exercent un droit de recours en cas de désaccord sur une évaluation, sans compter que le professeur doit également être transparent sur ce qu’il utilise pour rester en conformité et l’inscrire au registre des traitements. Bref, d’un côté comme de l’autre, tant du côté des élèves qui sont renvoyé à la fraude quelque soit la façon dont ils l’utilisent, que des professeurs, qui ne doivent l’utiliser qu’en pleine transparence, on se rend vite compte que l’usage de l’IA dans l’éducation reste, formellement, très contraint, pour ne pas dire impossible.

D’autres cadres et rapports ont été publiés. comme celui de l’inspection générale, du Sénat ou de la Commission européenne et de l’OCDE, mais qui se concentrent surtout sur ce qu’un enseignement à l’IA devrait être, plus que de donner un cadre aux débordements des usages actuels. Bref, pour l’instant, le cadrage de l’IApocalypse scolaire reste à construire, avec les professeurs… et avec les élèves.

Hubert Guillaud

MAJ du 02/09/2025 : Le rapport de François Taddei sur l’IA dans l’enseignement supérieur a été publié. Et, contrairement à ce qu’on aurait pu en attendre, il ne répond pas à la question des limites de l’usage de l’IA dans l’enseignement supérieur.

Le rapport est pourtant disert. Il recommande de mutualiser les capacités de calculs, les contenus et les bonnes pratiques, notamment via une plateforme de mutualisation. Il recommande de développer la formation des étudiants comme des personnels et bien sûr de repenser les modalités d’évaluation, mais sans proposer de pistes concrètes. « L’IA doit notamment contribuer à rendre les établissements plus inclusifs, renforcer la démocratie universitaire, et développer un nouveau modèle d’enseignement qui redéfinisse le rôle de l’enseignant et des étudiants », rappelle l’auteur de Apprendre au XXIe siècle (Calmann-Levy, 2018) qui militait déjà pour transformer l’institution. Il recommande enfin de développer des data centers dédiés, orientés enseignement et des solutions techniques souveraines et invite le ministère de l’enseignement supérieur à se doter d’une politique nationale d’adoption de l’IA autour d’un Institut national IA, éducation et société.