Dans sa newsletter, la journaliste et ethnographe Katherine Dee, se demande si nous sommes en train de passer à un internet post-alphabétique. Lorsque nous passons plus de temps dans le cyberespace que dans le monde réel, notre perception s’altère. Depuis au moins le Covid, notre rapport au numérique s’est accéléré. Tout le monde parle de la chute de la lecture, de la diminution de la capacité d’attention, de l’omniprésence des écrans. Nous sommes confrontés à une transformation où la voix et la vidéo semblent avoir pris le pas sur le texte.

Ce n’est pas seulement une transformation de notre manière de parler, une adaptation aux algorithmes, comme le défend le linguiste et influenceur Adam Aleksic dans son livre, Algospeak (Knopf, 2025, non traduit), où il analyse comment les réseaux sociaux nous poussent à modifier notre langage, par exemple pour contourner les modes de censure automatisés, à l’image du terme unalive qui est venu remplacer le terme suicide dans l’argot américain. Pour lui, expliquait-il au New York Times, avec le numérique les néologismes accélèrent, c’est-à-dire qu’ils semblent être plus nombreux que jamais et leur diffusion est plus rapide que jamais. « C’est un écosystème linguistique où les mots passent de la marge au courant dominant en quelques jours, et disparaissent parfois tout aussi vite ». C’est notre vocabulaire lui-même qui est bouleversé, secoué, transformé par notre rencontre avec les technologies numériques.

La présence plus que la patience

Katherine Dee explique qu’elle écoute les machines lire les newsletters auxquelles elle est abonnée plus souvent qu’elle ne les lit. « Nos machines ont aussi commencé à nous répondre, lentement et progressivement : d’abord Alexa et Siri, maintenant ChatGPT. Nous consommons davantage de sons et pensons à voix haute ». C’est un peu comme si nous avions plus qu’avant besoin de moduler notre expression pour comprendre nos émotions, comme le montrent toutes ces vidéos de gens en pleurs dans leurs voitures qui se confient à eux-mêmes et aux autres en vidéo. « La voix abolit la distance entre la pensée et l’expression. C’est le registre idéal pour une époque qui valorise la présence plus que la patience. Quand on parle à un appareil, ou qu’on écoute quelqu’un parler dedans, on s’affranchit du délai qu’imposait autrefois l’écriture. La pause entre l’idée et son expression, cette pause qui rendait l’écriture possible, a quasiment disparu ».

Dans un très long billet, le journaliste James Marriott constate que la lecture nous apprenait autrefois à penser de manière séquentielle – à ralentir et à structurer notre pensée – et que cette capacité se perd. Partout, la lecture est en recul. « Les sociétés orales pré-alphabétisées paraissent souvent aux visiteurs de pays alphabétisés remarquablement mystiques, émotionnelles et antagonistes », explique-t-il. « Avec la disparition progressive des livres, nous semblons revenir à ces habitudes de pensée orales. Notre discours sombre dans la panique, la haine et les conflits tribaux. La pensée anti-scientifique prospère jusqu’au plus haut niveau du gouvernement américain ».

« Sur le papier, leurs arguments sembleraient absurdes. À l’écran, ils sont persuasifs pour beaucoup ». « L’ignorance était un pilier de l’Europe féodale. Les profondes inégalités de l’ordre aristocratique pouvaient se maintenir en partie parce que la population n’avait aucun moyen de prendre conscience de l’ampleur de la corruption, des abus et des dysfonctionnements de ses gouvernements ». L’imprimé a été une condition préalable et indispensable à la démocratie, rappelle Marriott, qui s’inquiète des conséquences de sa disparition. « À l’ère des vidéos courtes [voir également notre article : « L’ère post-TikTok va continuer à bouleverser la société »], la politique favorise l’exacerbation des émotions, l’ignorance et les affirmations non étayées. Ces circonstances sont extrêmement propices aux charlatans charismatiques. Inévitablement, les partis et les politiciens hostiles à la démocratie prospèrent dans ce monde post-alphabétisé. L’utilisation de TikTok est corrélée à une augmentation du score électoral des partis populistes et de l’extrême droite. » « Les oligarques de la tech ont autant intérêt à l’ignorance de la population que le plus réactionnaire des autocrates féodaux. » Pour Marriott, nous risquons d’entrer dans un second âge féodal, celui de la société post-alphabétisée.

L’ère de l’oralité numérique

Ce qui émerge pourtant, soutient le spécialiste des médias, Andrey Mir, ce n’est pas l’illettrisme, c’est la post-alphabétisation. Selon lui, nous entrons dans « l’oralité numérique » – un retour aux schémas de pensée oraux, mais médiatisés par la technologie numérique. Un retour à l’impulsivité et à l’immersion environnementale. Dans l’interview que lui consacre Katherine Dee, Andrey Mir explique : « l’oralité numérique n’est ni vocale ni orale – ce n’est pas sa caractéristique principale. Il ne s’agit pas de transmettre des informations ou de communiquer oralement. L’oralité numérique est un phénomène culturel et cognitif induit par les nouveaux médias, qui peuvent ou non utiliser des canaux vocaux/audio ».

Avant l’écriture, les êtres humains étaient immergés dans un environnement physique (la nature) et social (la tribu). Ils recevaient simultanément des informations de leur environnement, à la manière d’un « espace acoustique », selon l’expression du théoricien des médias Marshall McLuhan. L’écriture les a détachés de cet environnement et les a contraints à se plonger dans la contemplation d’idées et de pensées. L’écriture a imposé l’isolement de la vision par rapport aux autres sens, instaurant un état cognitif particulier. Pour McLuhan, le sens isolé de la vision engourdissait les autres sens lorsqu’une personne écrivait ou lisait. Cet isolement visuel et cet engourdissement des autres sens ont transformé la capacité sensorielle de la vision en une faculté cognitive de vision intérieure – ce que Walter Ong appelait le « tournant vers l’intérieur ». L’isolement visuel et le détachement de l’environnement ont permis une concentration prolongée sur les idées.

Contrairement aux impulsions immédiates propres à l’oralité, l’écriture et la lecture ont permis un délai de réaction, mis à profit pour la contemplation, explique Andrey Mir. Cela a conduit à la délibération, ce qui, là encore, n’est pas typique de l’immersion environnementale « naturelle », où les individus réagissent vite et impulsivement. L’écriture, d’un point de vue purement technique, exige une organisation linéaire du contenu, ce qui a structuré la pensée elle-même. « Le repli sur soi cognitif, rendu possible par l’écriture, a conduit à la théorisation, à la classification, à l’individualisme, à l’introspection, à la structuration du savoir, au rationalisme, etc. » McLuhan avait déjà observé que la radio et la télévision – médias électroniques – requièrent une implication empathique. La « vocalité » de la transmission de l’information n’est pas essentielle, ce qui importe, ce sont les effets sensoriels et cognitifs du média. « Les médias numériques permettent non seulement une « implication empathique » dans l’environnement induit, mais aussi un engagement empathique. Ils ont transposé l’interactivité de type oral jusqu’à l’écriture. Le texte des courriels, et surtout des messageries instantanées et des réseaux sociaux, est utilisé à cette fin. De manière conversationnelle, comme une interaction dans un environnement partagé, semblable à la parole. C’est cela, l’oralité numérique », explique Mir. Elle est qualifiée « d’orale » non pas parce qu’elle est « vocale » (elle peut l’être, mais ce n’est pas essentiel), mais parce qu’elle est conversationnelle, impulsive et immersive. L’oralité numérique n’est donc pas un phénomène « phonétique », mais une condition cognitive et culturelle.

Paradoxalement, remarque-t-il, le principal « médium technique » de l’oralité numérique reste le texte ; non pas exactement le texte des livres (le texte de l’écriture), mais les SMS – et notamment les signes et les émojis qui servent la conversation et l’expression spontanée de soi, à la manière de la communication orale/tribale. L’oralité numérique achève la retribalisation de McLuhan, estime-t-il. Il s’agit d’un renversement du « repli sur soi » d’Ong, mais d’une manière particulière, à la manière d’un ruban de Möbius : un « repli sur soi-ouverture », car les utilisateurs numériques restent physiquement isolés tout en étant immergés dans un environnement numérique partagé.

Les technologies vocales (par exemple, Siri, Alexa, les mémos vocaux) accélèrent le déclin de la culture imprimée. Les interfaces vocales permettent une interaction conversationnelle, dans laquelle les interlocuteurs s’appuient l’un sur l’autre pour développer le dialogue et non pas seulement sur la structure du discours. L’utilisateur d’appareils vocaux s’engage dans un échange naturellement impulsif et réactif, qui requiert une implication émotionnelle plutôt qu’une réflexion rationnelle. « Tout média vocal et interactif favorise la prédominance de l’émotivité sur la rationalité et inverse de nombreuses autres caractéristiques essentielles de l’alphabétisation ». Habitués au confort et à l’intimité des appareils personnels, les utilisateurs du numérique sont conditionnés à maintenir des frontières physiques et sociales strictes, d’où l’anxiété sociale croissante des jeunes générations. « Ils n’interrogent pas l’IA en public ; ils lui envoient des SMS ou des messages. C’est plus intime et plus confortable ».

« Dès que les voitures autonomes libéreront les conducteurs des mains et des yeux, la part d’audience de la radio diminuera et rejoindra celle des journaux papiers parmi les espèces en voie de disparition. Si les médias d’ambiance (c’est-à-dire ceux qu’on écoute sans s’impliquer) vont rester, ils risquent de devenir secondaires », prophétise Andrey Mir.

« L’alphabétisation a structuré le monde à l’image d’un catalogue. L’éducation consistait essentiellement à étudier ce catalogue de connaissances pour accéder à des savoirs plus spécialisés ». Les premiers sites web étaient organisés comme des livres ou des bibliothèques, avec des tables des matières ou des catalogues. Le champ de recherche a sonné le glas du catalogue. Plus besoin de se souvenir des connaissances engrangées ou de l’arborescence de son ordinateur, puisqu’il suffit d’interroger le champ de recherche de son ordinateur, un moteur de recherche ou une intelligence artificielle générative. La compétence cruciale désormais dans ce mode de fonctionnement est la capacité à formuler des questions pertinentes pour obtenir la meilleure réponse. Une capacité qui ne repose en rien sur la maîtrise de l’écrit traditionnel.

« Une autre compétence médiatique essentielle consiste à apprendre non pas comment utiliser un média, mais comment ne pas l’utiliser ». Comprendre la dimension hormonale de la consommation médiatique est essentiel à l’éducation aux médias, car cela peut nous aider à éteindre un appareil ou à passer d’un appareil à l’autre, avance-t-il encore.

« Les personnes ayant connu une ère pré-numérique savent généralement qu’un effort important engendre des récompenses importantes et multiples. Lire Dostoïevski demande un effort considérable, mais apporte non seulement une révélation intellectuelle, mais aussi un statut social et l’épanouissement personnel ». « Construire une relation amoureuse demande des efforts soutenus, mais apporte bien plus que des relations sexuelles : le confort du mariage et la sécurité de la famille. Cette récompense substantielle exige un effort conséquent – c’était là l’essence même du système effort-récompense dans le monde physique. Les appareils numériques récompensent de simples clics, mais cette récompense est minime. Elle ne satisfait jamais pleinement ; elle se contente de maintenir l’utilisateur en marche. Cela modifie radicalement les circuits neurophysiologiques liés à l’effort et à la récompense. Les médias numériques récompensent la simple présence – un clic suffit pour se montrer, afficher ses préférences – et, par conséquent, c’est la simple présence, et non l’effort, qui acquiert de la valeur. Sur les plateformes numériques, « faire » n’a pas la même importance que dans le monde physique ; ce qui compte, c’est « être » – signaler sa présence. »

Cette configuration cognitive engendre des conséquences culturelles profondes. La prédominance de « être » sur « faire » conduit à la génération « flocon de neige » et aux politiques identitaires, où l’identité prime sur le mérite. Ce que vous faites importe peu. L’important désormais, c’est l’identité. Et c’est pourquoi on la perçoit comme un gage de réussite, exigeant des récompenses ou des sanctions basées sur l’identité et non sur les actes.

Un autre effet de la transition numérique est la diminution de la capacité des individus à fournir des efforts soutenus. Le cerveau n’est pas conditionné à fournir un effort soutenu et prolongé lorsque la récompense se résume à un simple clic. Par conséquent, le niveau d’éducation baisse, les carrières deviennent plus difficiles à construire, la vie personnelle plus ardue, etc. Globalement, l’anxiété sociale augmente.

La solution à ce problème commence par l’éducation parentale, explique encore Mir. En règle générale, l’accès des enfants aux différents médias devrait suivre les étapes de l’évolution médiatique de l’humanité : jouets et jeux actifs, écoute des récits des parents, lecture, médias électroniques, et seulement ensuite, vers l’âge de 14 ans, appareils tactiles. Si cet ordre est inversé et que les appareils numériques précèdent les jouets et les livres, le cerveau ne bénéficiera pas de la stimulation neuronale associée aux médias précédents : coordination œil-main, orientation spatiale, concentration, persévérance, effort soutenu et récompense différée.

Cependant, le monde est déjà passé des médias imprimés aux appareils numériques, et nous vivons actuellement la transition de la culture écrite à l’oralité numérique. Aucune stratégie personnelle ne peut annuler ou inverser ce changement, conclut-il. Nous devons donc nous y adapter.

Le copier-coller, comme oralité

Dans la Suite dans les idées, Sylvain Bourmeau recevait récemment le chercheur Allan Deneuville, auteur notamment de Copier-Coller, le tournant photographique de l’écriture numérique (UGA,2025) qui expliquait que l’un de nos gestes d’écriture le plus courant, le copier-coller, n’en est pas un. Pour lui, cela consiste à écrire avec de la photographie, car copier-coller, consiste bien plus à photographier un texte et à le déplacer. Dans l’acte même de copier-coller, on n’écrit pas. Le copier-coller, au même titre que les SMS ou les vocaux, tient d’un support de l’oralité numérique.

Deneuville pose les mêmes questions que Mir : nous n’interrogeons pas suffisamment ce que signifie écrire avec de la photographie. « Qu’est-ce que cela change à l’écriture et à la pensée, quand écrire ne consiste plus à écrire, ne consiste plus à faire passer la manière textuelle par notre propre écriture dans la pensée ? » La copie est aussi ancienne que l’écriture, rappelle Deneuville. Elle répond à deux injonctions : aller vite et être exacte. La copie manuscrite et photographique finissent par se mélanger avec la photocomposition et le photocopieur. Le copier-coller, inventé par Larry Tesler chez Xerox date de cette même époque.

Pour Deneuville, le copier-coller a des effets sur notre manière même d’écrire. Le copier-coller est d’abord un moyen de mieux écrire, comme les élèves ont recopié Wikipédia ou les contenus de l’IA. Nous devons trouver les modalités d’une « pédagogie du copié-collé », car le copié-collé permet tout de même d’avoir une connaissance accrue des textes. Quand on copie-colle, l’enjeu est de masquer ce qui est copié, de le faire disparaître, explique-t-il. Il faut une compréhension logique du texte pour éviter les ruptures. C’est la mythologie de l’écriture elle-même qu’il faut défaire, estime Deneuville. C’est-à-dire nous défaire du « fantasme de l’écriture ».

Pour Bourmeau, copier-coller, c’est cadrer et composer, ce qui nécessite bien plus de créativité qu’on le pense. Pour Deneuville, voilà longtemps que nous savons considérer la photographie comme de l’art. Faire de la photographie avec du texte, devrait nous inviter à faire du traveling, du cadrage, du collage, de la contextualisation, de la composition, du montage… de texte.

Pour Deneuville, l’arrivée de l’IA dans les apprentissages sonne comme une panique morale, notamment pour tous ceux qui ont une pratique professionnelle de l’écriture. Si cette panique est certainement exagérée tant nous réifions l’écriture, nous ne devons pas pour autant diminuer les risques que l’IA fait peser. Les étudiants l’utilisent d’abord pour écrire sans faire de fautes : c’est notre rapport social qui est interrogé par ces outils qui nous poussent à écrire mieux.

Vers la folklorisation d’internet ?

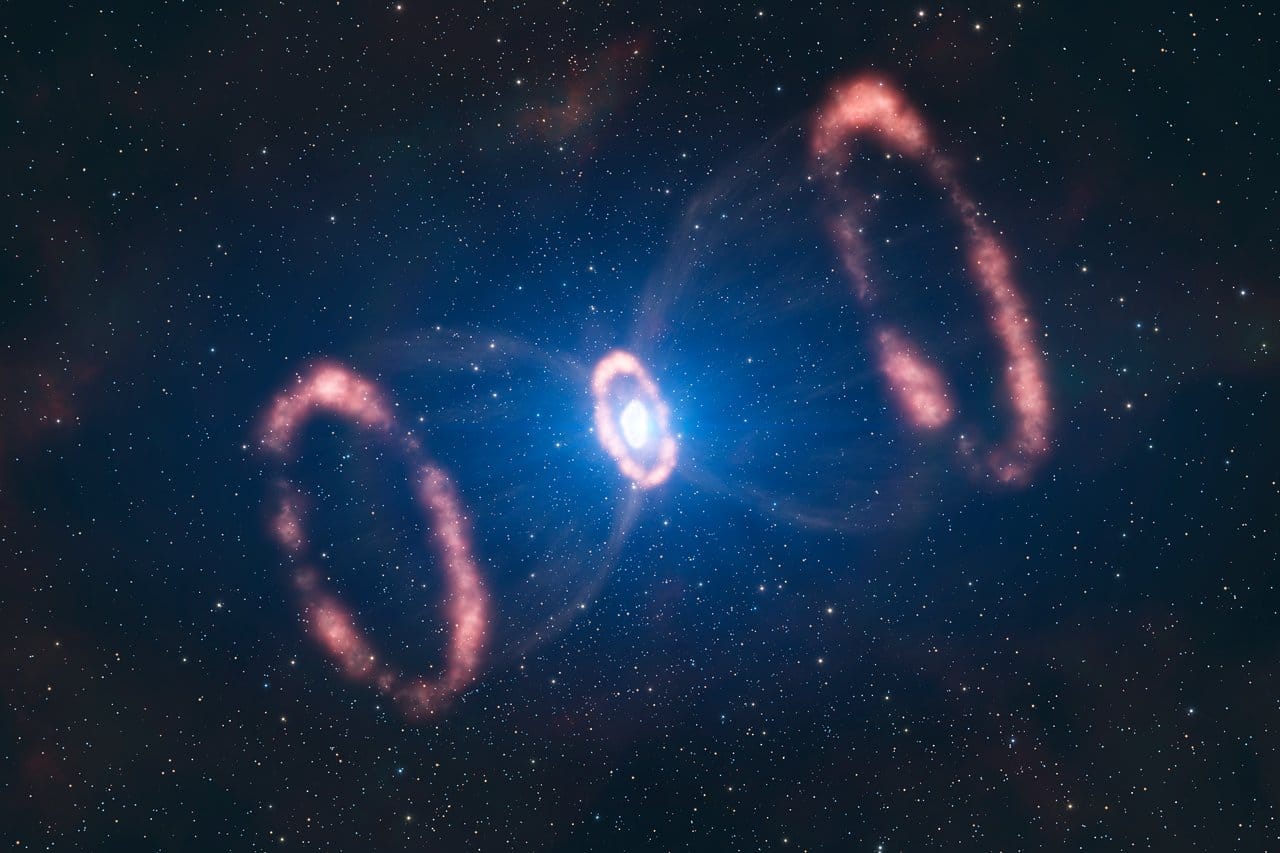

« Internet est inondé d’images politiques générées par l’IA que personne ne prend pour la réalité », explique la psychologue sociale finlandaise Zea Szebeni dans un billet pour la newsletter Peripheral Politics. Le débat sur la désinformation, s’est beaucoup concentré sur les deepfakes, ces contrefaçons réalistes utilisées comme outils de déstabilisation politique… qui présentent des risques réels. Mais ce débat oublie que l’essentiel des images générées par l’IA n’ont pas la prétention à tromper. Bien souvent, personne ne les prend pour la réalité. Elles viennent la compléter, construire une atmosphère émotionnelle autour de la réalité, lui donner des formes de résonances émotionnelles, comme si elle permettait de générer un folklore, c’est-à-dire « des variations infinies sur les mêmes archétypes, constamment adaptés et partagés », qui façonnent notre perception sans jamais prétendre à la réalité.

Dans les cultures orales, la « vérité » ne résidait pas principalement dans l’exactitude des faits, mais dans la résonance, rappelle la chercheuse : une histoire avait de l’importance si elle aidait les gens à comprendre leur monde, si elle pouvait être mémorisée et partagée. Puis vinrent l’écriture et l’imprimerie, qui ont tout changé. L’alphabétisation a encouragé la pensée linéaire et l’idée que la vérité pouvait être figée dans des textes faisant autorité. L’information est devenue vérifiable par la consultation des sources. Mais les médias numériques nous ramènent en arrière. Walter Ong a appelé cela une « oralité secondaire » ; nous n’avons pas perdu l’écriture, mais nous avons acquis en parallèle un système qui ressemble à la communication orale.

L’information ne réside plus dans un stockage stable, mais dans une circulation constante. Comme le souligne le journaliste de Vox, Eric Levitz : « l’information ne s’ancre pas lorsqu’elle est stockée ; elle s’ancre lorsqu’elle circule ». Ainsi, la répétition crée la réalité. Dans ce contexte, les images politiques générées par l’IA fonctionnent moins comme des affirmations factuelles que comme des mythes en circulation – évaluées non pas comme vraies ou fausses, mais comme pertinentes ou insipides.

« Nous ne sommes pas (seulement) confrontés à une crise où il est devenu impossible de distinguer le vrai du faux. Nous sommes confrontés à quelque chose de plus étrange encore, où la vérité se heurte aux récits mythiques, et dans cette compétition, les faits sont souvent désavantagés. » Mais si on peut débunker une fausse information ou un deepfake, il est plus difficile de défaire un folklore. Pour Zea Szebeni, ces productions tiennent du « lore », d’un univers folklorique, des récits qui se répètent, circulent, s’inscrustent. « Ces productions n’ont pas besoin de tromper pour fonctionner ; il leur suffit de circuler, de se répéter, de s’intégrer à la mythologie ambiante dans laquelle nous baignons. Et comme l’IA rend la production de mythes quasi gratuite, nous vivons tous désormais au sein de multiples légendes concurrentes, chacune renforcée par l’abondance algorithmique ». Ces lores fabriquent des perceptions, les recyclent, les renforcent, même si on sait qu’elles sont fausses. La circularité des fausses images de Trump par exemple renforce sa présence, sa posture, qu’elles soient jugées pertinentes pour les uns ou délirantes pour les autres. Le folklore entretient les représentations, comme l’IA les sédimentent.

404 MediaSamantha Cole

404 MediaSamantha Cole

404 MediaSamantha Cole

404 MediaSamantha Cole