Le 25 juillet 2025, dans le cadre de la loi sur la sécurité en ligne (Online Safety Act, OSA) adoptée en 2023, les nouvelles règles de vérification de l’âge sont entrées en vigueur au Royaume-Uni, pour les sites proposant du contenu qualifié de « dangereux », notamment pornographique (mais pas seulement). La loi britannique définit des catégories pour les services en ligne auxquels elle s’applique, en fonction de leurs fonctionnalités et de leur nombre d’utilisateurs actifs par mois. En regard, sont définies différentes catégories de contenus, allant de contenus dits illégaux à des contenus dits nuisibles aux enfants. La loi ne se contente pas de faire la chasse à la pornographie en ligne, c’est-à-dire à des contenus à caractères sexuels explicites, mais déborde très largement de ce seul cadre qui ouvre, en regard des sanctions lourdes, et impose une modération des contenus qui peut aller jusqu’aux images violentes de l’actualité (et pas seulement sanglantes) voire à tous propos sur la sexualité, comme ceux abordant les questions de santé.

Un renforcement sans précédent de la surveillance et de la censure préventive : la conformité n’est pas contournable

Comme le pointe l’une des plus synthétiques et lumineuses analyses en français sur le loi que j’ai pu lire, celle de Nicolas Morin sur son blog, la loi demande aux plateformes un « devoir de diligence » proactif et fondé sur les risques, mais également impose un comportement « préventif », rendant les plateformes, sites et services en ligne, directement responsables de la sécurité de leurs utilisateurs et du contenu qu’ils rencontrent. « Enfin ! », pourrait-on s’enthousiasmer en pensant qu’on exige un peu plus de contrôle de la part des Gafams. Sauf que le champ d’application de la loi est très large et dépasse les seules plateformes de médias sociaux et les plus grands services en ligne. Elle s’applique jusqu’aux forums, commentaires de blogs et sites de partage de fichiers, même si les obligations les plus strictes s’appliquent aux plateformes les plus importantes.

Les services en ligne doivent garantir que les enfants aient un « accès adapté à leur âge », ce qui implique une approche faisant appel à des systèmes de filtrage et de modération de contenu adaptés aux différents groupes d’âge qui s’imposent partout. « Les sanctions prévues sont sévères, potentiellement existentielles, en cas de manquement. Les amendes peuvent atteindre 18 millions de livres sterling ou 10 % du chiffre d’affaires annuel mondial d’une entreprise, et les cadres supérieurs peuvent être tenus personnellement responsables pénalement en cas de non-coopération avec le régulateur. » Du fait de la lourdeur des sanctions, avec l’OSA, la conformité réglementaire n’est pas contournable.

Mais surtout, explique Morin, « à un niveau fondamental, l’OSA illustre la bascule d’une logique procédurale à une logique de valeurs ». Jusqu’à présent, la modération de contenu suivait une approche procédurale, se concentrant sur le « comment » plutôt que sur le « quoi ». Cette logique ne disait pas aux plateformes quel contenu spécifique (en dehors de ce qui est déjà manifestement illégal) était bon ou mauvais. Elle imposait plutôt des obligations de moyens et de transparence (souvent très légères, comme des conditions de modération claires, des mécanismes de signalement simples, des processus d’appels, des rapports sur les contenus modérés…). Avec l’OSA et son approche sur les valeurs, les plateformes doivent porter un jugement même sur les contenus et leur impose une obligation de résultat. « Ce faisant, la loi délègue aux entreprises privées et à l’organe de régulation britannique (l’Ofcom) le soin de définir ce qui constitue un discours acceptable dans la société, une mission qui relève normalement du débat démocratique et de la loi pénale ». Le problème est que les contenus qui peuvent être qualifiés de préjudiciables est large et introduit un flou juridique supplémentaire, qui, à l’aune de la sévérité des sanctions, conduit déjà chacun à une sur-modération. « Pour les utilisateurs, l’application des règles devient arbitraire. Un même contenu pourra être supprimé un jour et toléré le lendemain, en fonction du modérateur ou de l’algorithme qui l’examine. Il n’y a plus de prévisibilité, un principe fondamental de l’État de droit ».

« En utilisant des termes vagues, le Parlement britannique a, de fait, délégué son pouvoir normatif. Ce ne sont plus les législateurs élus qui définissent précisément les limites de la liberté d’expression, mais l’Ofcom, un régulateur non élu, qui publiera des codes de pratique pour “interpréter” ce que la loi entend par “préjudiciable”, et les plateformes elles-mêmes, qui créeront leurs propres règles internes pour se conformer aux interprétations de l’Ofcom.

Le débat sur ce que notre société tolère comme discours est ainsi retiré de la sphère publique et démocratique pour être confié à des comités de conformité et des régulateurs techniques.

En passant d’une logique procédurale à une logique de valeurs incarnée par des termes vagues, l’Online Safety Act crée un système où la censure devient préventive, privatisée et arbitraire. La quête légitime de sécurité en ligne, sous l’étendard ici de la sécurité des enfants et de la lutte contre le terrorisme, se fait au détriment de la liberté d’expression, de la sécurité juridique et des principes démocratiques fondamentaux. »

« L’obligation pour les plateformes de gérer le contenu « préjudiciable » mais légal les amène, par prudence, à classifier et restreindre l’accès à un large éventail de contenus, y compris les reportages d’actualité, la couverture de la guerre et des conflits, le journalisme d’investigation et les images de manifestations politiques, qui pourraient tous être considérés comme « préjudiciables » ou « dépeignant une violence grave » selon les définitions larges de la loi. Ce système délègue de fait aux entreprises technologiques privées le rôle d’arbitres de l’État en matière de discours acceptable. Alors que les partisans pourraient y voir une application de la responsabilité, les critiques y voient un « cadeau massif à la grande technologie ». Cela renforce leur pouvoir en leur donnant une autorité mandatée par l’État pour décider de ce que les utilisateurs peuvent et ne peuvent pas voir, une fonction quasi-judiciaire pour laquelle les entreprises privées sont institutionnellement mal adaptées et démocratiquement irresponsables. »

Le premier problème de l’OSA est bien le large spectre de ce que son champ réglementaire couvre. Ce n’est pas une loi qui cherche à réguler uniquement les vidéos et les images pornographiques.

Vers une modération fonctionnelle

La loi s’applique aux sites web, aux services de réseaux sociaux, aux sites de stockage et de partage de fichiers, aux forums en ligne, aux applications de rencontre et aux services de messagerie instantanée. Tous sont désormais tenus de vérifier l’âge des visiteurs si leurs plateformes contiennent du contenu préjudiciable ou inapproprié, rappelle le New York Times. Au-delà des sites pornographiques, les applications qui ont introduit la vérification de l’âge incluent Grindr, le service de rencontres gay ; Discord, l’application de chat social ; et Reddit… Même l’encyclopédie Wikipédia reste menacée de devoir intégrer une vérification d’âge (notamment parce qu’elle entre dans la catégorie des grands services en ligne).

La majorité des Britanniques – près de 80 % – se sont déclarés favorables aux nouvelles règles, selon un sondage YouGov auprès d’environ 4 400 adultes, peut-être sans toujours comprendre que ces règles ne concernaient pas que les contenus sexuellement explicites, puisqu’après la mise en place des premières mesures effectives, ils n’étaient plus que 69% à soutenir les règles. Mais, selon l’enquête, seule une personne sur quatre environ estime que ces restrictions empêcheront réellement les enfants d’accéder à la pornographie en ligne. Au Royaume-Uni, une vague de résistance s’est également manifestée. Plus de 500 000 personnes ont signé une pétition demandant l’abrogation de la loi sur la sécurité en ligne, critiquée par les défenseurs du droit à la vie privée et de la liberté d’expression. Ces derniers affirment que ces règles constituent un exemple d’abus de pouvoir du gouvernement et les jugent dangereuses pour les personnes souhaitant préserver leur anonymat en ligne.

Les critiques affirment également que la portée des règles va trop loin, en incluant les forums de loisirs en ligne et divers autres sites. Ils affirment que les petits sites qui ne disposent pas des ressources nécessaires pour se conformer à la loi devront fermer, notamment parce qu’ils s’exposent à des poursuites juridiques inédites.

Les contenus sont définis en trois catégories : des contenus primaires prioritaires préjudiciable aux enfants (les contenus pornographiques et de promotion du suicide notamment), les contenus prioritaires préjudiciables aux enfants (contenus incitant à la haine, à l’intimidation ou à la violence notamment) et des contenus non désigné comme dangereux pour les enfants mais qui peuvent leur porter préjudice, c’est-à-dire les perturber, comme des images de violences ou de manifestation. Le problème consiste bien sûr dans les flous de ces définitions : un article qui parle d’un suicide en fait-il la promotion ? Parler des violences d’une guerre ou de manifestations est-il préjudiciable ? Même la définition de la pornographie peut-être plus ou moins lâche : un texte érotique est-il de même nature qu’une vidéo explicite ?

Face à ces risques, les sites accessibles doivent mettre en œuvre un certain nombre de mesures et notamment la « vérification vigoureuse de l’âge », en développant des algorithmes plus sûrs pour les jeunes publics et en renforçant la modération des contenus.

Depuis l’entrée en vigueur de ces mesures fin juillet, les plateformes de réseaux sociaux Reddit, Bluesky, Discord et X ont toutes mis en place des contrôles d’âge pour empêcher les enfants de consulter des contenus préjudiciables sur leurs sites. Des sites pornographiques comme Pornhub et YouPorn ont mis en place des contrôles d’âge, demandant désormais aux utilisateurs de fournir une pièce d’identité officielle, une adresse e-mail pour que la technologie analyse les autres services en ligne où elle a été utilisée, ou de soumettre leurs informations à un fournisseur tiers pour vérification de l’âge. Des sites comme Spotify exigent également que les utilisateurs soumettent un scan facial à Yoti, une société tierce de gestion d’identité numérique, pour accéder aux contenus étiquetés 18+. L’Ofcom, qui supervise la mise en œuvre de l’OSA, est allé plus loin en envoyant des lettres pour tenter de faire appliquer la législation britannique aux entreprises basées aux États-Unis.

La généralisation de la vérification d’âge et du contrôle parental

La contrainte de la vérification d’âge n’est pas que britannique. Elle concerne également l’Union européenne, les Etats-Unis (une vingtaine d’Etats ayant déjà légiféré en ce sens) et l’Australie. « En France, deux lois successives ont entériné depuis 2020 la vérification d’âge », rappelait Le Monde cet été. En juin, menacé de sanctions par l’Autorité de régulation de la communication audiovisuelle et numérique (Arcom) s’il ne mettait pas en place une procédure de vérification d’âge, Pornhub a fermé ses accès en France. Si l’Europe a lancé une enquête à l’encontre des principales plateformes de contenus pornographiques, pour qu’elles mettent en place des outils de vérification d’âge plus approprié qu’un simple déclaratif, au motif du DSA et de la taille de leur audience, la Commission estime que fixer une majorité numérique ne relève pas de ses compétences, même si elle travaille à proposer une solution harmonisée de vérification d’âge des internautes. En novembre, les députés macronistes ont déposé une proposition de loi pour interdire les réseaux sociaux aux moins de 15 ans, imposer un couvre-feu numérique pour les 15-18 ans de 22 heures à 8 heures, ainsi que l’interdiction des smartphones dans les lycées. Des perspectives défendues par le président lui-même. Des propositions d’interdiction des réseaux sociaux aux moins de 15 ans sont également à l’ordre du jour au Danemark, en Norvège, et au Royaume-Uni (via un autre projet de loi, le Protection of Children Bill).

En Australie, une loi nationale a d’ores et déjà été adoptée. Elle interdit l’accès aux réseaux sociaux aux moins de 16 ans. En revanche, les applications de messagerie ou celles dévolues à l’éducation et à la santé sont exclues de cette réglementation, tout comme YouTube – sans qu’on comprenne très bien les motivations de cette exclusion.

« Parallèlement, tous les grands réseaux sociaux ont mis en place, au fil du temps, des outils de contrôle parental et de protection des adolescents, qui permettent notamment de limiter le temps d’utilisation de l’application par les plus jeunes. Certaines plateformes, comme Instagram ou TikTok, limitent ainsi les fonctionnalités des comptes créés par les mineurs, qui sont notamment paramétrés par défaut comme « privés », c’est-à-dire dont le contenu n’est accessible qu’aux personnes acceptées par l’utilisateur.

Les grandes plateformes assurent également utiliser toute une série d’outils automatisés pour détecter les internautes qui mentent sur leur âge lors de leur inscription. En avril, Meta – maison mère d’Instagram – a ainsi annoncé son intention de tester aux Etats-Unis l’utilisation de l’intelligence artificielle pour repérer les profils des jeunes s’étant fait passer pour des adultes afin de les basculer automatiquement en « comptes adolescents ».

La plupart des réseaux sociaux arguent toutefois que la responsabilité du contrôle ne devrait pas leur échoir, mais être confiée aux opérateurs téléphoniques ainsi qu’à Apple et à Google. Ce sont ces deux entreprises qui gèrent les magasins d’applications et sont plus à même, selon les grandes plateformes, de contrôler facilement l’âge des utilisateurs. »

Certains États américains ont également commencé à introduire des législations pour restreindre l’accès à certains sites, notamment pornographiques, aux mineurs, rappelait Le Monde. Les lois de l’Utah et du Texas sont particulièrement contraignante, rappelle la chercheuse Meg Leta Jones pour Tech Policy Press : elles demandent de vérifier l’âge de tous les utilisateurs et les classent en quatre catégories : enfant (moins de 13 ans), jeune adolescent (13-15 ans), adolescent plus âgé (16-17 ans) et adulte (18 ans et plus). « Les deux lois exigent des plateformes d’applications : (1) qu’elles vérifient l’âge des utilisateurs lors de leur inscription par des « méthodes commercialement raisonnables » (par exemple, pièce d’identité, carte de crédit, lecture biométrique), (2) qu’elles relient les comptes des enfants à ceux de leurs parents, (3) qu’elles obtiennent l’autorisation des parents avant que les enfants puissent télécharger des applications ou effectuer des achats, (4) qu’elles indiquent aux développeurs d’applications l’âge de chaque utilisateur et si les parents ont donné leur autorisation, (5) qu’elles informent les parents des modifications importantes apportées aux applications (comme une nouvelle collecte de données) et qu’elles obtiennent à nouveau leur autorisation, et (6) qu’elles transmettent les informations relatives à l’âge aux développeurs de manière sécurisée et chiffrée ». Des mesures qui devraient permettre à l’Etat de poursuivre ceux qui ne les mettraient pas en œuvre au motif de pratiques commerciales trompeuses en vertu de la loi sur la protection des consommateurs et aux parents de porter plainte directement contre les applications et les boutiques d’applications.

La loi Californienne, elle, privilégie l’auto-déclaration de l’âge (sans vérification d’exactitude). « La Californie exige : (1) un écran simple lors de la configuration de l’appareil demandant aux utilisateurs de saisir leur âge ou leur date de naissance ; (2) que le système d’exploitation partage automatiquement cette information d’âge avec les applications lors de leur téléchargement ; et (3) que les boutiques d’applications obtiennent l’autorisation parentale avant que les enfants de moins de 16 ans puissent télécharger des applications ». Ces différences permettent de comprendre pourquoi Google a soutenu le projet Californien et s’oppose aux projets du Texas et de l’Utah, explique la chercheuse Meg Leta Jones. Au Texas, les géants du web s’opposent à une loi imposant la vérification d’âge sur les magasins d’application d’Apple et Google, au prétexte de la liberté. Facebook soutient pourtant l’obligation faite aux magasins d’applications de procéder aux vérifications d’âge, afin de ne pas avoir à le faire lui-même. Pornhub également. La loi sur la responsabilité des App Stores (App Store Accountability Act) en discussion au Congrès vise pourtant à étendre l’approche de l’Utah et du Texas, mais en plaçant son respect sous la responsabilité de la Commission fédérale du commerce afin d’éliminer les recours privés de parents contre des applications qui ne se conformeraient pas à la législation. Le projet de loi fédéral permettrait d’harmoniser les modalités de contrôle d’âge aux Etats-Unis, explique The Verge.

Pour l’instant, la vérification d’âge avance donc en ordre dispersé et tente de faire peser des obligations à certains acteurs plus qu’à d’autres. Plutôt que d’être organisée dès l’achat d’appareil ou la création de comptes, elle a tendance à se propager partout, pour mieux exercer son carcan et éliminer ses failles – quand on pourrait peut-être chercher plutôt à faire progresser globalement les limites d’accès, plutôt que de les imposer partout et penser qu’elles doivent être sans failles. Enfin, la vérification d’âge ne vient pas seule, notamment aux Etats-Unis, où elle se raffine d’un droit de regard renforcé des parents sur les téléphones de leurs enfants, notamment avec le développement du contrôle parental..

Vers un nouvel internet : le contrôle identitaire et moral généralisé

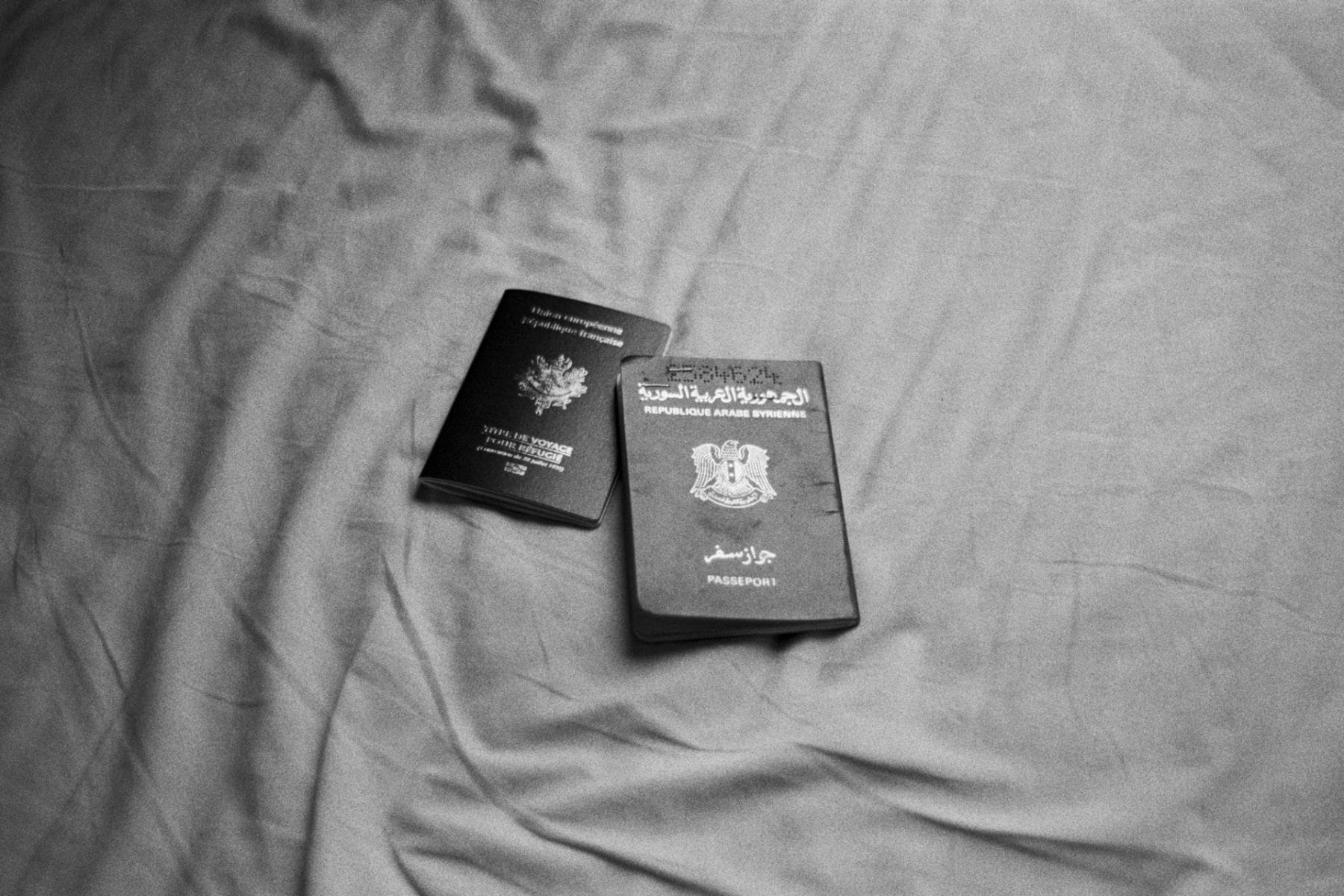

Pour Wired, nous franchissons une nouvelle étape dans l’ère d’un internet de plus en plus contrôlé, qui pourrait mettre fin à l’anonymat en ligne, comme l’explique Riana Pfefferkorn, chercheuse en politiques publiques à l’Université de Stanford. « Si les gens choisissent de ne pas se connecter [aux moteurs de recherche] pour éviter les contrôles d’âge, cela pourrait avoir un impact considérable sur les méthodes de recherche d’informations en ligne, rationalisées et intégrées », explique Lisa Given, professeure de sciences de l’information à l’Université RMIT en Australie. Pour Riana Pfefferkorn de Stanford : « En fin de compte, la technologie de vérification de l’âge présente un risque pour les enfants qu’elle est censée protéger. Elle entrave leur accès à l’information et peut les exposer à des risques de violation de la vie privée, d’usurpation d’identité et d’autres problèmes de sécurité. » Pour Emanuel Maiberg et Samantha Cole de 404media, les techniques de vérification d’âge s’apprêtent à « refondre en profondeur de l’infrastructure d’Internet ». Pornhub est pourtant, scandale après scandale, bien plus modéré qu’il n’a jamais été. Le risque que fait introduire la vérification d’âge est celui d’un développement de « sites qui ne tiennent aucun compte de la loi et où certains des contenus les plus nocifs disponibles en ligne leur sont activement proposés ». Au Texas, où Pornhub est désormais bloqué, c’est Xvideos qui s’impose désormais et d’autres sites hébergés dans des pays bien moins regardant, avec des contenus plus problématiques encore. Ce que proposent les lois de vérification d’âge, c’est de « ré-embrayer sur le piratage », estiment les journalistes de 404media, c’est-à-dire que le renforcement des règles risque surtout d’assombrir les pratiques faisant naître des galaxies de sites qu’il sera plus difficile de réguler, comme la lutte contre le piratage a contribué à l’exacerber.

Dans le nouvel internet qu’introduit la vérification d’âge, l’enjeu n’est pas seulement qu’il va être pénible de devoir s’identifier partout en activant la vérification d’âge localement, mais bien plus qu’il n’y aura plus d’internet sans identification. Le mouvement, déjà largement amorcé partout par l’authentification généralisée ne va faire que se renforcer en tentant de réduire toujours plus les espaces de liberté. Au final, la vérification d’âge va surtout renforcer les grands acteurs, ceux seuls à même de développer ces technologies de contrôle.

Reste à savoir si la vérification d’âge nous promet un internet plus sécurisé et plus sûr ? Cela risque d’être le cas pour les mineurs effectivement, qui partout autour du monde risquent d’avoir de moins en moins accès à internet et moins accès à l’information quelles que soient ses qualités. Mais, la vérification d’âge ne promet pas une amélioration de la protection pour tous, au contraire. Elle va surtout permettre d’ouvrir les vannes des machines pour tous les majeurs. Elle risque surtout de renforcer la modération pour les plus jeunes et de l’arrêter pour tous les autres. C’est ainsi qu’il faut lire les annonces d’OpenAI à permettre à ses chatbots de produire des contenus érotiques. C’est le sens qu’il faut d’ailleurs donner à un autre projet de loi américain, dénoncé par l’EFF, la loi GUARD, qui oblige à un contrôle d’âge qui s’imposerait à tous les chatbots d’IA destinés au public.Si l’accès aux chatbots va se fermer pour les mineurs, la crise des chatbots compagnons, elle, risque surtout de se résoudre par son accélération.

Ce que promet la vérification d’âge, finalement, c’est un internet fermé aux enfants et aux adolescents et un internet beaucoup moins sûr pour tous les autres. Un peu comme si on concentrait la régulation sur le seul principe de l’âge et de la responsabilité individuelle. En fait, il est probable que ces lois renforcent encore le peu de prise qu’ont les utilisateurs sur les politiques de modération « unilatérales décidées par les plateformes », comme l’expliquait le chercheur Tarleton Gillespie dans son livre, Custodians of the internet (Les gardiens de l’internet, 2018, Yale University Press, non traduit – voir notre recension).

Comme si tous les autres types d’intervention n’avaient pas d’importance. danah boyd ne disait pas autre chose : les projets de lois visant à exclure les plus jeunes des réseaux sociaux ne proposent de mettre en place aucune ceinture de sécurité, mais seulement de ne pas les accueillir dans les véhicules au risque qu’ils ne puissent plus se déplacer. « Les enfants regardent leurs parents plongés toute la journée sur leur téléphones et on est en train de leur dire qu’ils ne pourront y avoir accès avant 18 ans ! En fait, on fait tout pour ne pas interroger les processus de socialisation et leurs limites ». Nous mettons en place un solutionnisme techno-légal. « Le cadre réglementaire n’énonce pas d’exigences de conception spécifiques que les plateformes devraient éviter et n’observent que les résultats qu’elles doivent atteindre ». Le risque enfin, c’est qu’au prétexte du contrôle, nous enterrions toutes les autres modalités politiques, allant de l’éducation à la conception des plateformes. Avec la vérification d’âge, on propose finalement aux géants de concentrer leur modération sur l’exclusion des mineurs, au détriment de toute autre politique.

Hubert Guillaud