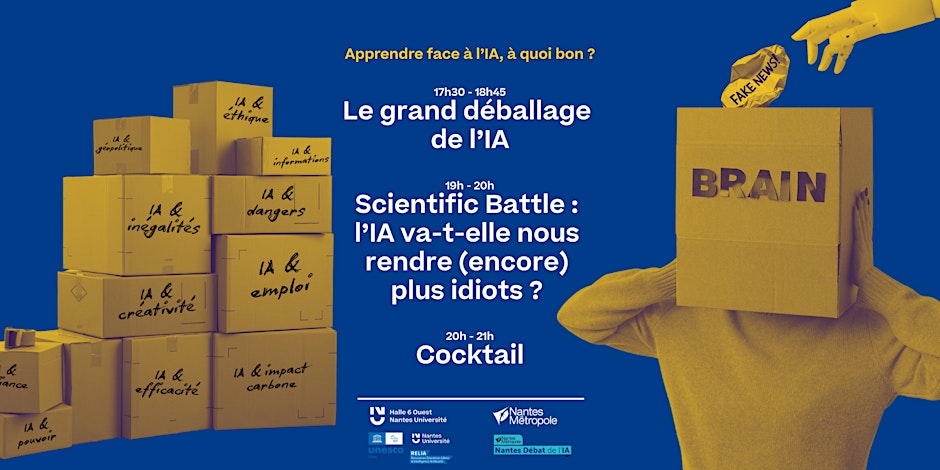

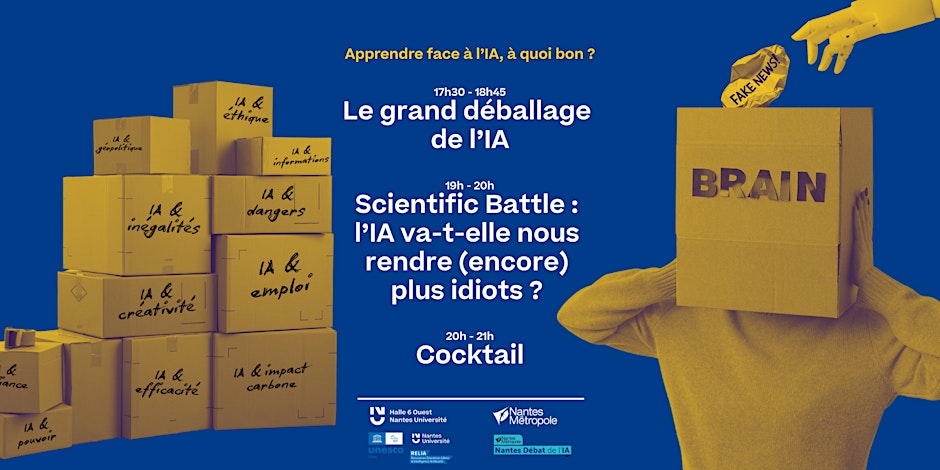

A l’invitation de la chaire Unesco RELIA de l’université de Nantes et dans le cadre de la Nantes Digital Week, j’étais ce vendredi 19 Septembre 2025 en bonne compagnie pour une « Scientific Battle » sur le thème suivant : « L’intelligence artificielle va-t-elle nous rendre (encore) plus idiots ? »

Voici ce que j’y ai dit, sachant que le format était celui de la contrainte : 3 minutes et basta. Je vous livre donc ces trois minutes mais aussi (et peut-être surtout) des réflexions complémentaires.

Ce que j’ai dit à la Scientific Battle en 3 minutes

(douche comprise)

366 avant JC, Platon dans le Phèdre se demande si l’écriture ne va pas nous rendre idiots et nous faire « perdre la mémoire ». Vingt-trois siècles plus tard, en 2008 Nicolas Carr se demande : « Google va-t-il nous rendre stupides ? » Et aujourd’hui donc on se demande : « l’IA va-t-elle nous rendre encore plus idiots. » Vous noterez le « encore » qui est bien de circonstance

Plutôt que de parler d’IA je vais me concentrer sur ce que j’appelle (dans ce magnifique livre) les artefacts génératifs (les outils comme ChatGPT, Midjourney, Le Chat, Claude, Gemini, etc.). Vont-ils nous rendre encore plus idiots ?

D’abord ils nous font faire moins d’effort. Ces technologies allègent à la fois notre coût cognitif (« l’attribution de ressources attentionnelles à une tâche ») et notre bagage cognitif (ce que cela mobilise comme connaissances).

From « ChatGPT » to « CouchGPT »

Ensuite ils démobilisent notre attention. On devient plus crédule. Ces technologies abaissent notre seuil de vigilance. L’idée (comme les notifications) c’est d’installer des arcs-réflexe, des routines, qui, à force, nous évitent non pas « de penser » ou « de réfléchir » mais de se souvenir qu’il faut penser ou qu’il faut réfléchir, par exemple à ce que ces artefacts génératifs nous disent, à pourquoi ils nous le disent et à comment ils nous le disent. D’autant qu’on a documenté ce que des chercheurs (Jacob, Kerrigan, Bastos 2025) appellent le « chat-chamber effect », le fait que nous « fassions confiance aux hallucinations de l’IA » dès lors que les informations / hallucinations vont dans le sens de nos croyances ou de notre questionnement, même si ces informations sont incorrectes, non contrôlées et non vérifiées. Le titre complet de leur article c’est : « L’effet ‘Chat-Chamber’ : faire confiance aux hallucinations de l’IA« .

Et puis ces artefacts génératifs nous rendent moins exigeants. Ces technologies abaissent aussi notre seuil d’exigence parce qu’elles jouent sur un biais de disponibilité exacerbé qui se double d’une dimension de biais d’opacité (l’information est disponible, certes, mais difficile de savoir d’où elle a été tirée). Le biais de disponibilité c’est « se baser uniquement ou principalement sur les informations immédiatement disponibles en mémoire. » Et là on doit se demander : mais dans la mémoire de qui ? ChatGPT c’est la mémoire de … qui ? Des auteurs, photographes et des créateurs dont les oeuvres sont pillées (Anthropic a récemment promis un chèque d’1,5 milliards de dollars à un collectif d’auteurs pour éviter un procès) ? D’artefacts génératifs précédents dont les productions sont à leur tour mises en mémoire ? Avec déjà des formes de consanguinité « générative » qui sont accablantes comme ces images jaunies à force d’être copiées sur style Ghibli ou de manière générale des mécanismes d’effondrement de modèles autophages ?

Alors en effet quand on fait moins d’efforts (intellectuels), quand on fait moins attention, et quand on est moins exigeant intellectuellement, il est possible que l »on soit un peu plus idiot qu’avant.

Il y a une citation de Philippe Meirieu qui me semble très bien résumer tout cela : « l’IA comble le désir de savoir mais tue le désir d’apprendre. »

Pourtant au commencement, les idiots c’était pas nous ; les idiots c’étaient clairement ces IA et ces artefacts génératifs. Et vas-y que ça te proposait des recettes d’omelettes avec des oeufs de mouton, et vas-y que ça t’expliquait pourquoi « Jean-Paul Sartre avait écrit Le Petit Bonhomme en mousse », et vas-y que, de manière bien plus préoccupante, ça t’indiquait que « oui on a des doutes sur l’existence de la Shoah ».

Et puis on s’est mis à leur parler beaucoup et on a oublié ce que disait Audiard : « J’parle pas aux cons ça les instruit. » Maintenant on a une question à se poser : on fait quoi collectivement de ces artefacts génératifs très très cons que nous avons contribué à instruire (mais très incomplètement et très imparfaitement) ? On en fait quoi alors même qu’ils n’ont jamais eu et qu’ils n’auront jamais … aucun désir d’apprendre ? Pour le savoir on peut bien sûr poser la question à ChatGPT ; ou alors on peut aussi commencer par relire le Phèdre de Platon.

Moralité ? Je ne suis pas certain que ça nous rende tous encore plus idiots, mais je suis presque totalement convaincu que ça ne pas nous rendre collectivement plus intelligents.

Ce que je n’ai pas dit à la Scientific Battle.

(parce que ça ne tenait pas en 3 minutes)

L’IA c’est vaste, ça permet en médecine de sauver des vies et de détecter des cancers précocement, de concevoir de nouvelles molécules et de faire du design de protéines, mais ça permet aussi de faire du ciblage marketing émotionnel pour vous afficher des pubs juste au moment où vous êtes le plus « disponible », et puis ça fait vos devoirs à votre place et puis dès que vous avez une idée totalement crétine ou criminelle (genre transformer Gaza en Riviera), bah ça l’illustre et lui donne vie directement, ça imprègne, ça imprime, ça impressionne.

Je ne crois pas que les technologies (quelles qu’elles soient) nous rendent idiots. Par contre elles changent, modifient, transforment notre rapport au monde. La voiture, le train, l’avion ont moins modifié notre rapport à la vitesse et au déplacement individuel que notre rapport collectif à la géographie du monde. L’imprimerie a moins modifié notre rapport individuel à la lecture que notre rapport collectif aux structures sociales du pouvoir et de la contestation du pouvoir ; elle a transformé les anciens régimes de vérité et en a inauguré de nouveaux. Les moteurs de recherche, les réseaux sociaux et maintenant l’IA ont moins modifié notre rapport individuel à la question de l’accès à l’information et aux connaissances que notre rapport collectif à celles et ceux qui étaient jusque-là garants de la production d’informations vérifiées et de connaissances procédant par accumulation et respect de procédures scientifiques.

La question n’est donc pas tant de savoir ce que ces technologies nous font mais ce qu’elles font au monde et, surtout, ce que nous ferons et serons encore capables de faire dans le monde qu’elles façonnent.

Le grand paradoxe de ces technologies d’intelligence artificielle, via leurs artefacts génératifs, c’est qu’elles ne nous fatiguent pas (cf leur coût cognitif quasi nul) mais qu’elles produisent des formes d’épuisement de la langue et du réel. Ces générations artificielles n’ajoutent pas à nos imaginaires, à nos possibles, elles leur enlèvent, elles leurs ôtent quelque chose par les instanciations systématiques et à coût nul de chaque réponse, de chaque possible, de chaque probable. Pour paraphraser le titre de l’ouvrage d’un philosophe célèbre, elles nous placent dans un monde qui n’est vu que comme représentations et plus comme volonté. Ce sont des technologies du retrait, de la mise en retrait. Alors bien sûr il y a des exceptions : le domaine médical et celui de la recherche fondamentale dans le domaine de la biologie, de la physique, et quelques autres encore. Mais dans ces domaines ces technologies sont exactement à leur place, c’est à dire que nous leur commandons de faire à notre place sur la base d’instructions et de méthodologies claires : leur capacité de calcul est mobilisée dans les lignes et contraintes que nous définissons, elles sont assignées. Alors que dans la sphère médiatique informationnelle de leur propagation, elles définissent un agenda d’assujettissement qui répond aux commandes des infrastructures de pouvoir qui les hébergent et les commandent.

Ce qu’il nous faut craindre, ce sont les alignements de tous nos effondrements. Effondrements de la parole journalistique, de l’espace médiatique, du lien social, de l’exercice politique du pouvoir. Mais aussi leurs pourrissements volontaires par les affrontements culturels autour de cette internationale capitaliste réactionnaire et néo-fasciste. Et au milieu donc les effondrements des IA et des artefacts génératifs. Or nous entrons dans une époque où tous ces pourrissements volontaires et où tous ces effondrements documentés s’alignent et font cadre. Ils deviennent un déterminisme qui nous conduit vers un abîme ; un abîme que nous regardons avec la lucidité que nous apportent celles et ceux qui le documentent sur le plan politique, historique, journalistique (les derniers numéros Fascisme 2.0 et Guerres de la revue AOC en sont une remarquable synthèse) mais pour lequel il semble que l’inertie soit désormais trop grande pour pouvoir l’éviter.

Comme l’écrivait Beckett, « Fini, c’est fini, ça va finir, ça va peut-être finir. Les grains s’ajoutent aux grains, un à un et un jour, soudain, c’est un tas, un petit tas, l’impossible tas. » L’impossible est en train d’advenir.

Et au milieu de cet impossible il y a ces chiffres et cette frénésie comptable qui est la nouvelle phrénologie de l’essentialisation capitaliste de nos pulsions et de nos désirs (Stiegler parlait d’une économie libidinale). Ces chiffres en voici quelques-uns qui concernent ChatGPT : « 700 millions d’usagers, qui lui adressent chaque jour 2,6 milliards de requêtes. » (Google c’est plus de 13 à 16 milliards par jour).

Et cette question supplémentaire : que sont devenus les gens à qui nous ne posons plus ces questions parce que nous les posons à Google ou à ChatGPT ? Et quelles auraient été leurs réponses ? Que serions-nous devenus dans ces échanges, ces réponses ou ces absences de réponses immédiates ? Que seraient devenues nos singulières errances d’ignorance, vers quel destin ou quels ailleurs nous auraient-elles conduites ? Et quelles réponses collectives leurs auraient alors été apportées ? De cela nous n’en saurons jamais rien. Il ne nous reste alors que le frémissement d’une inquiétude, clinique, la même que celle qui traversait Apostolos Gerasoulis (le papa du moteur de recherche Ask Jeeves) lorsqu’il s’interrogeait en regardant défiler les dix millions de requêtes quotidiennes d’Ask Jeeves : « Je me dis parfois que je peux sentir les sentiments du monde, ce qui peut aussi être un fardeau. Qu’arrivera-t-il si nous répondons mal à des requêtes comme ‘amour’ ou ‘ouragan’ ? »

Il n’est qu’une seule manière d’apaiser cette inquiétude, c’est d’avoir la certitude que Sam Altman (dirigeant d’OpenAI), Daniela Amodei et Dario Amodei (fondateurs et dirigeants d’Anthropic), Arthur Mensch, Guillaume Lample et Timothée Lacroix (fondateurs et dirigeants de Mistral AI) et quelques autres se posent et se poseront tous les jours cette même question et qu’elle guide et guidera chacune de leurs décisions. Et comme c’est une certitude que nous n’aurons jamais, notre seul impératif est de la leur poser sans cesse, sans trêve et sans relâche.